Web Scraping và Web Crawling: Sự Khác Biệt và Trường Hợp Sử Dụng

Trong sự phát triển của internet hiện đại, việc thu thập và sử dụng dữ liệu ngày càng trở nên quan trọng. Dù là để phân tích thị trường, lấy thông tin tin tức, hay cung cấp hỗ trợ dữ liệu cho nghiên cứu khoa học, web scraping và web crawling là hai công nghệ thường được sử dụng rộng rãi. Tuy nhiên, nhiều người nhầm lẫn khái niệm của hai công nghệ này, nghĩ rằng chúng là cùng một công nghệ. Thực tế, trong khi web scraping và web crawling có những điểm tương đồng, nguyên lý hoạt động, kịch bản ứng dụng và chi tiết kỹ thuật của chúng khác nhau. Bài viết này sẽ đi sâu vào sự khác biệt giữa hai công nghệ và thảo luận về các kịch bản ứng dụng của chúng.

Web Crawling

1. Web Crawling là gì?

Web crawling, thường được gọi là "spider" hoặc "bot," có nhiệm vụ cốt lõi là khám phá và lập chỉ mục. Nó hoạt động như một nhà thám hiểm điều hướng qua mê cung của internet, bắt đầu từ một trang web và nhảy đến trang khác bằng cách nhấp vào các liên kết trên trang, lặp lại chu trình này.

2. Cách Crawlers Hoạt Động

Crawlers không quan tâm đến các bảng hoặc giá cụ thể; chúng quan tâm nhiều hơn đến cấu trúc và mối quan hệ.

Seed URL: Bắt đầu từ một URL đã cho.

Extract Links: Xác định tất cả các liên kết trên trang.

Update Index: Ghi lại các trang mới được phát hiện.

Follow Protocols: Các crawler chuyên nghiệp ưu tiên đọc tệp robots.txt của trang web để xác nhận các khu vực nào được phép truy cập.

3. Các Trường Hợp Đại Diện

Các Công Cụ Tìm Kiếm (Google, Bing, Baidu): Đây là ứng dụng lớn nhất của crawlers. Chúng liên tục crawl để đảm bảo tính kịp thời của kết quả tìm kiếm.

Kiểm Tra Tình Trạng Website: Tự động kiểm tra xem có liên kết chết (lỗi 404) trên trang web hay không.

Web Scraping

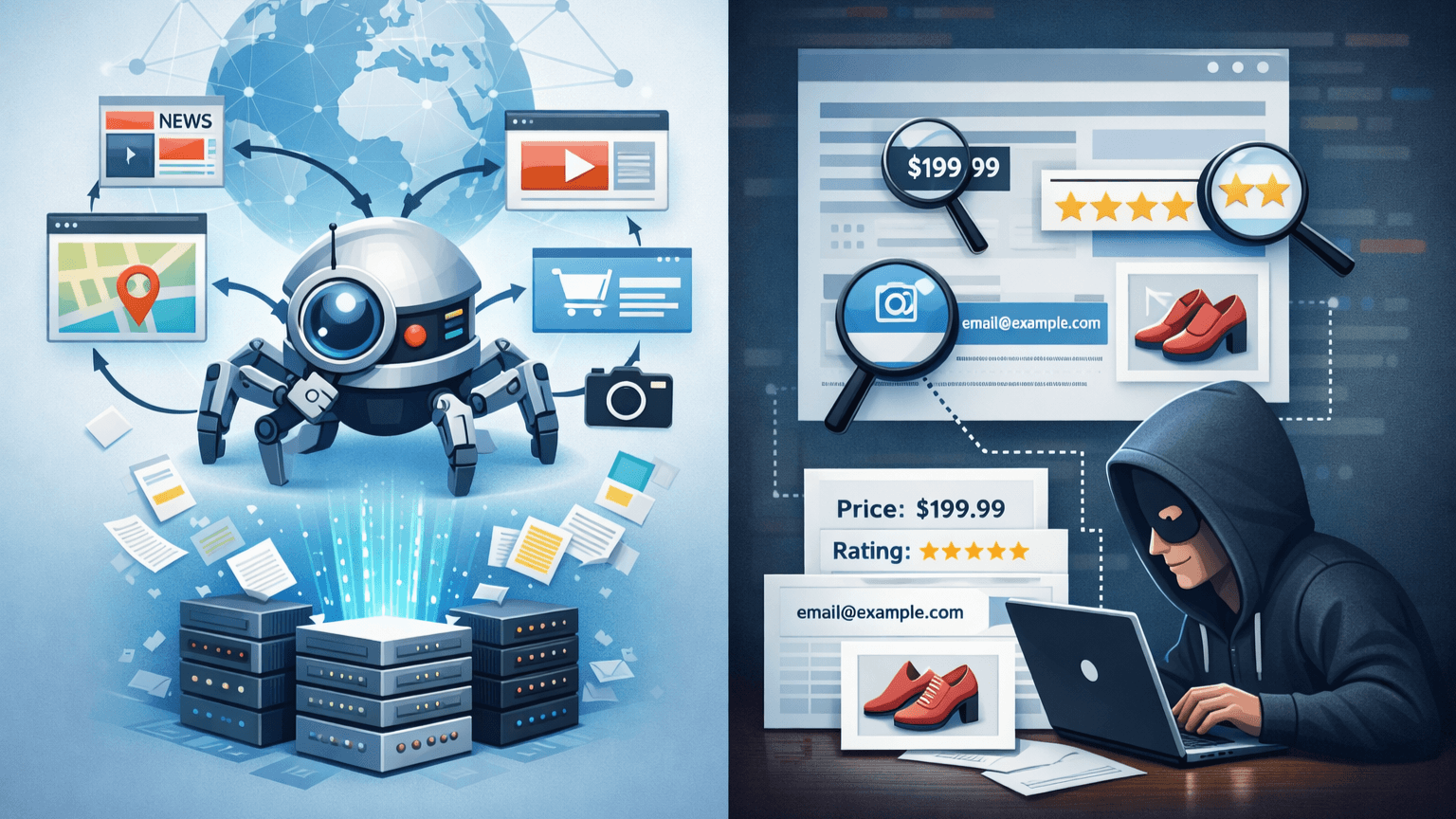

1. Web Scraping là gì?

Web scraping là quá trình trích xuất dữ liệu cụ thể. Nếu crawling giống như việc lập bản đồ một khu rừng, scraping là việc trực tiếp đến một cái cây cụ thể để hái trái cây đó.

2. Cách Scraping Hoạt Động

Scrapers thường được tùy chỉnh cho các trang web mục tiêu cụ thể.

Parse HTML: Bằng cách phân tích mã nguồn của trang web (sử dụng XPath, CSS Selector, v.v.), xác định chính xác dữ liệu cần thiết.

Dọn Dẹp Dữ Liệu: Chuyển đổi nội dung trang web không có cấu trúc thành định dạng có cấu trúc (như JSON, CSV hoặc Excel).

Lưu Trữ: Lưu trữ các số điện thoại, giá sản phẩm hoặc bình luận đã trích xuất vào cơ sở dữ liệu.

3. Các Trường Hợp Đại Diện

Theo Dõi Giá: Trích xuất giá sản phẩm từ Amazon hoặc các nền tảng thương mại điện tử khác cho các chiến lược đấu thầu.

Phân Tích Tâm Lý: Trích xuất các bài đăng với từ khóa cụ thể từ mạng xã hội để phân tích tâm lý công chúng.

So Sánh Sâu: Scraping vs Crawling

Để minh họa rõ ràng sự khác biệt giữa hai công nghệ, chúng ta có thể so sánh chúng trong bảng dưới đây:

| Kích Thước | Web Crawling | Web Scraping |

|---|---|---|

| Mục Đích Cốt Lõi | Khám phá, lập chỉ mục, tìm kiếm, lập bản đồ | Trích xuất, chuyển đổi, lưu trữ, phân tích dữ liệu |

| Chiều Rộng vs Chiều Sâu | Chiều rộng đầu tiên, trải rộng hàng triệu miền | Chiều sâu đầu tiên, tập trung vào các trang hoặc lĩnh vực cụ thể |

| Tập Trung Kỹ Thuật | Trích xuất liên kết, loại bỏ trùng lặp, theo dõi robots.txt | Phân tích HTML, chiến lược chống scraping, dọn dẹp dữ liệu |

| Định Dạng Kết Quả | Cơ sở dữ liệu chỉ mục (Chỉ mục tìm kiếm) | Tệp có cấu trúc (CSV, JSON, SQL) |

| Công Cụ Điển Hình | Apache Nutch, Scrapy (chế độ hàng loạt) | Beautiful Soup, Selenium, Puppeteer |

Chúng Hoạt Động Cùng Nhau Như Thế Nào?

Trong các dự án quy mô lớn, scraping và crawling thường hoạt động như một "cặp đôi vàng."

Hãy tưởng tượng bạn đang xây dựng một nền tảng phân tích bất động sản toàn quốc:

Giai Đoạn Crawling: Bạn viết một crawler nhảy qua các trang web của các đại lý bất động sản lớn, thu thập các URL của tất cả các trang chi tiết bất động sản và lưu trữ các URL này trong một hàng đợi.

Giai Đoạn Scraping: Bạn thiết kế một scraper cho các trang chi tiết này, cụ thể trích xuất "giá," "mét vuông," "vị trí," và "năm xây dựng" từ mỗi trang.

Nâng Cao Hiệu Quả Scraping và Vượt Qua Các Khối

1. Sử Dụng Proxy Trong Web Crawling

Khi các crawler scrape các trang trên internet một cách rộng rãi, trang web mục tiêu có thể xác định lưu lượng bất thường do các yêu cầu thường xuyên và chặn IP, khiến quá trình scraping dừng lại. Trong những trường hợp như vậy, việc sử dụng proxy có thể giải quyết hiệu quả vấn đề này.

IP Rotation: Bằng cách quản lý một nhóm proxy, các crawler có thể liên tục thay đổi địa chỉ IP để tránh bị xác định là lưu lượng bất thường bởi trang web mục tiêu. Một nhóm proxy là một tập hợp của nhiều proxy IP mà từ đó các crawler có thể chọn ngẫu nhiên các IP cho các yêu cầu.

Vượt Qua Các Khối IP: Một số trang web thiết lập chính sách chặn IP dựa trên tần suất truy cập và nguồn gốc của địa chỉ IP. Bằng cách sử dụng proxy, các crawler có thể vượt qua những hạn chế này để scraping liền mạch.

Tùy Chỉnh Khu Vực và Ngôn Ngữ: Các máy chủ proxy có thể cung cấp địa chỉ IP từ các khu vực khác nhau, điều này rất quan trọng cho các nhiệm vụ scraping yêu cầu nội dung khu vực cụ thể. Ví dụ, khi lấy thông tin giá sản phẩm từ Mỹ, một proxy IP của Mỹ có thể được sử dụng để mô phỏng truy cập của người dùng địa phương.

2. Sử Dụng Proxy Trong Web Scraping

Tương tự như web crawling, web scraping cũng cần tận dụng proxy để vượt qua các biện pháp chống scraping trên một số trang web. Đặc biệt khi scraping các nền tảng thương mại điện tử lớn, mạng xã hội hoặc trang tin tức, các yêu cầu thường xuyên có thể dẫn đến việc cấm tài khoản hoặc chặn IP. Do đó, proxy có thể đảm bảo tính liên tục và ổn định của việc trích xuất dữ liệu.

Ngăn Chặn Cấm IP: Khi khối lượng dữ liệu trên nền tảng scraping rất lớn, việc sử dụng proxy có thể tránh bị cấm bởi trang web mục tiêu do các yêu cầu tần suất cao.

Tránh Các Chiến Lược Chống Scraping: Một số trang web xác định hành vi scraping tự động bằng cách phát hiện IP, User-Agent, Cookie và các thông tin khác. Sử dụng proxy có thể giảm thiểu rủi ro bị nhận diện là crawler bằng cách thay đổi IP một cách linh hoạt và mô phỏng truy cập của người dùng thực.

Các Kịch Bản Ứng Dụng

1. Điều Chỉnh Giá Thời Gian Thực Trong Thương Mại Điện Tử

Các ông lớn thương mại điện tử scrape hàng tồn kho và giá của đối thủ để thực hiện điều chỉnh giá tự động bằng cách sử dụng thuật toán. Điều này yêu cầu tần suất cực kỳ cao và khả năng chống chặn, thường liên quan đến việc sử dụng proxy IP.

2. Machine Learning và Đào Tạo AI

Các LLM hiện tại (Mô Hình Ngôn Ngữ Lớn) như GPT-4 dựa vào việc crawling quy mô lớn. Chúng scrape một lượng lớn văn bản từ Wikipedia, tài liệu học thuật, báo cáo tin tức, v.v., cung cấp tài liệu học cho các mô hình.

3. Đầu Tư Tài Chính và Đánh Giá Tín Dụng

Các quỹ đầu cơ scrape dữ liệu bán hàng hoặc thông tin logistics từ các nhà bán lẻ để dự đoán hiệu suất tài chính. Các ngân hàng có thể scrape thông tin kiện tụng công khai về các công ty để đánh giá kiểm soát rủi ro.

Pháp Lý và Đạo Đức: Đường Ranh Không Thể Chạm Đến

Dù là crawling hay scraping, các hoạt động phải được thực hiện trong khuôn khổ pháp lý.

Bản Quyền và Quyền Sở Hữu: Mặc dù dữ liệu là công khai, việc scraping quy mô lớn và thương mại hóa có thể vi phạm quyền sở hữu cơ sở dữ liệu.

Bảo Vệ Quyền Riêng Tư: Việc scraping dữ liệu liên quan đến quyền riêng tư cá nhân (PII) là nghiêm cấm, chẳng hạn như số ID cá nhân không được phép, hồ sơ trò chuyện riêng tư, v.v.

Tải Máy Chủ: Tần suất scraping quá mức tương đương với một cuộc tấn công DDoS, có thể khiến máy chủ mục tiêu bị sập.

Kết Luận

Bây giờ bạn đã hiểu sự khác biệt và ứng dụng của web crawlers và web scraping.

IPDeep cung cấp các proxy IP chất lượng cao cho web crawling và web scraping, bao gồm:

và nhiều loại proxy khác, với hơn 10 triệu tài nguyên IP chất lượng cao phủ sóng hơn 200 quốc gia và khu vực trên toàn thế giới. Tạo tài khoản ngay bây giờ để thử nghiệm dịch vụ proxy của chúng tôi miễn phí!