Web Scraping ve Web Crawling: Farklar ve Kullanım Senaryoları

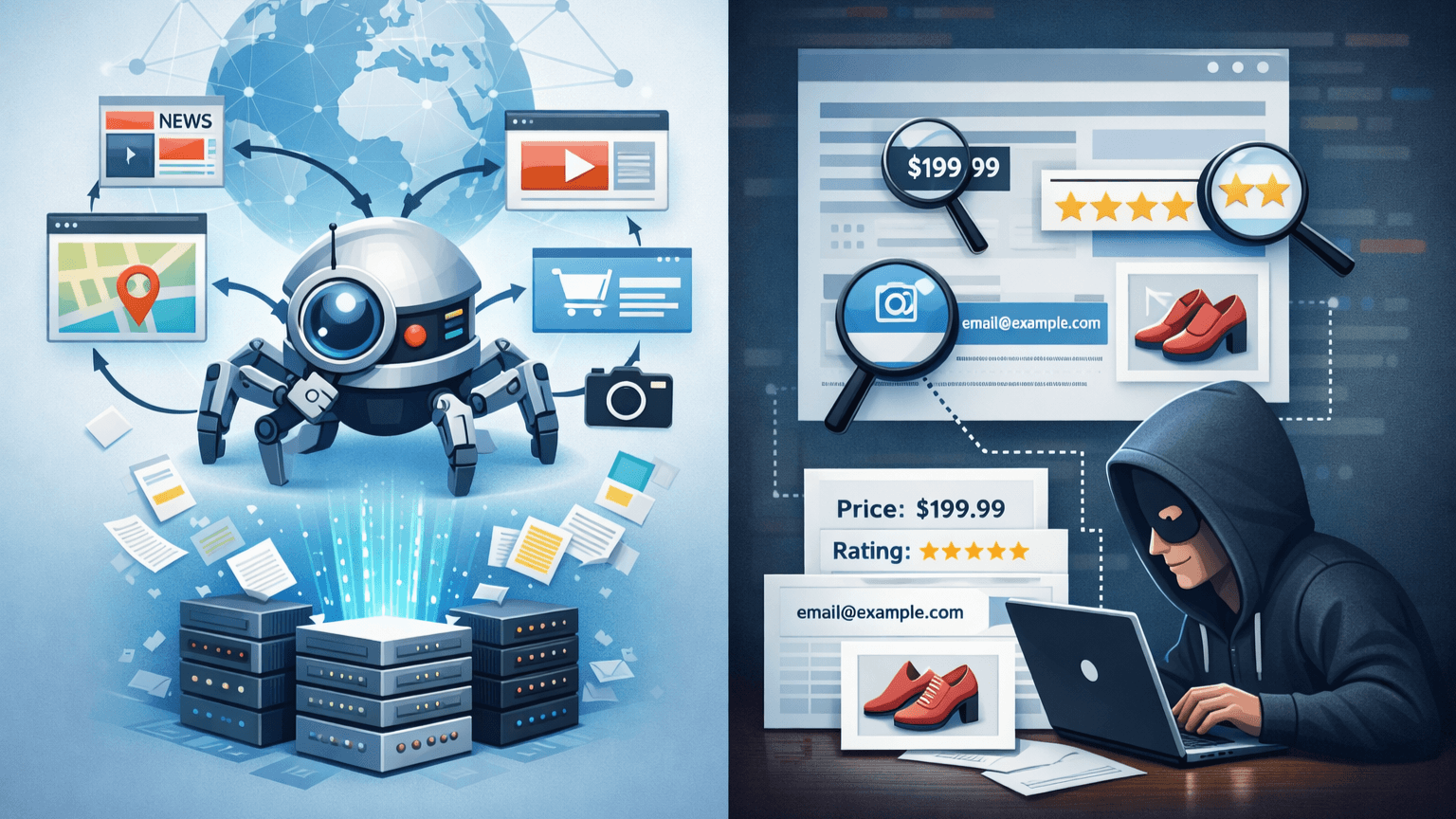

Modern internetin gelişiminde, veri edinimi ve kullanımı giderek daha önemli hale gelmiştir. Pazar analizi, haber bilgisi edinme veya bilimsel araştırmalar için veri desteği sağlama amacıyla, web scraping ve web crawling sıkça kullanılan iki teknolojidir. Ancak, birçok insan bu iki kavramı karıştırmakta ve aynı teknoloji olduklarını düşünmektedir. Aslında, web scraping ve web crawling benzerlikler taşısa da, çalışma prensipleri, uygulama senaryoları ve teknik detaylar açısından farklılık gösterir. Bu makalede, ikisi arasındaki farklar derinlemesine incelenecek ve ilgili uygulama senaryoları tartışılacaktır.

Web Crawling

1. Web Crawling Nedir?

Web crawling, genellikle "örümcek" veya "bot" olarak adlandırılır ve temel görevi keşfetmek ve dizinlemektir. İnternetteki labirentte gezinirken bir kaşif gibi hareket eder, bir web sayfasından başlayarak sayfadaki bağlantılara tıklayarak bir diğerine geçer ve döngüyü tekrarlar.

2. Crawlers Nasıl Çalışır

Crawlers belirli tablolar veya fiyatlarla ilgilenmez; daha çok yapı ve ilişkilerle ilgilenirler.

Seed URL: Verilen bir URL'den başlar.

Bağlantıları Çıkar: Sayfadaki tüm hiperlinkleri tanımlar.

Dizin Güncelle: Yeni keşfedilen sayfaları kaydeder.

Protokollere Uygunluk: Profesyonel crawlers, erişime izin verilen alanları doğrulamak için web sitesinin robots.txt dosyasını okumayı öncelikli olarak tercih eder.

3. Temsilci Durumlar

Arama Motorları (Google, Bing, Baidu): Bu, crawlers'ın en büyük uygulamasıdır. Arama sonuçlarının güncelliğini sağlamak için sürekli olarak tarama yaparlar.

Web Sitesi Sağlık Kontrolü: Web sitesinde ölü bağlantıların (404 hataları) olup olmadığını otomatik olarak kontrol eder.

Web Scraping

1. Web Scraping Nedir?

Web scraping, belirli verileri çıkarmak sürecidir. Tarama, bir ormanı haritalamak gibiyse, scraping belirli bir ağaca gidip o özel meyveyi toplamak gibidir.

2. Scraping Nasıl Çalışır

Scrapers genellikle belirli hedef web sayfaları için özelleştirilmiştir.

HTML'yi Ayrıştır: Web sayfasının kaynak kodunu ayrıştırarak (XPath, CSS Seçici vb. kullanarak), gereken veriyi doğru bir şekilde bulur.

Veri Temizleme: Yapılandırılmamış web sayfası içeriğini yapılandırılmış bir formata (JSON, CSV veya Excel gibi) dönüştürür.

Depolama: Çıkarılan telefon numaralarını, ürün fiyatlarını veya yorumları bir veritabanında saklar.

3. Temsilci Durumlar

Fiyat İzleme: Amazon veya diğer e-ticaret platformlarından ürün fiyatlarını alarak teklif stratejileri için kullanır.

Duygu Analizi: Sosyal medyadan belirli anahtar kelimeleri içeren gönderileri alarak kamu duyarlılığını analiz eder.

Derinlemesine Karşılaştırma: Scraping vs Crawling

İkisi arasındaki farkları net bir şekilde göstermek için, aşağıdaki tabloda karşılaştırabiliriz:

| Boyut | Web Crawling | Web Scraping |

|---|---|---|

| Temel Amaç | Keşfetmek, dizinlemek, aramak, haritalamak | Veri çıkarmak, dönüştürmek, depolamak, analiz etmek |

| Genişlik vs Derinlik | Genişlik öncelikli, milyonlarca alanı kapsar | Derinlik öncelikli, belirli sayfalara veya alanlara odaklanır |

| Teknik Odak | Bağlantı çıkarımı, yinelenmeyi önleme, robots.txt dosyasını takip etme | HTML ayrıştırma, anti-scraping stratejileri, veri temizleme |

| Sonuç Formatı | Dizin veritabanı (Arama Dizini) | Yapılandırılmış dosyalar (CSV, JSON, SQL) |

| Tipik Araçlar | Apache Nutch, Scrapy (toplu mod) | Beautiful Soup, Selenium, Puppeteer |

Birlikte Nasıl Çalışırlar?

Büyük ölçekli projelerde, scraping ve crawling genellikle "altın çift" olarak çalışır.

Ulusal bir gayrimenkul analiz platformu oluşturduğunuzu hayal edin:

Crawling Aşaması: Büyük gayrimenkul ajansı web siteleri arasında zıplayan bir crawler yazarsınız, tüm mülk detay sayfalarının URL'lerini toplar ve bu URL'leri bir kuyruğa kaydedersiniz.

Scraping Aşaması: Bu detay sayfaları için bir scraper tasarlarsınız, her sayfadan "fiyat", "metrekare", "konum" ve "yapım yılı" gibi bilgileri özel olarak çıkarırsınız.

Scraping Verimliliğini Artırma ve Engelleri Aşma

1. Web Crawling'de Proxylere Kullanma

Crawlers, internette sayfaları yoğun bir şekilde tararken, hedef web sitesi sık sık yapılan istekler nedeniyle anormal trafiği tanımlayabilir ve IP'yi engelleyebilir, bu da scraping sürecinin durmasına neden olur. Bu gibi durumlarda, proxy kullanmak bu sorunu etkili bir şekilde çözebilir.

IP Döngüsü: Bir proxy havuzunu yöneterek, crawlers sürekli olarak IP adreslerini değiştirerek hedef web sitesi tarafından anormal trafik olarak tanımlanmaktan kaçınabilir. Proxy havuzu, crawlers'ın istekler için rastgele IP'ler seçebileceği çok sayıda proxy IP içeren bir koleksiyondur.

IP Engellerini Aşma: Bazı web siteleri, erişim sıklığına ve IP adreslerinin kaynağına dayalı olarak IP engelleme politikaları belirler. Proxy kullanarak, crawlers bu kısıtlamaları aşarak kesintisiz scraping yapabilir.

Bölgesel ve Dil Özelleştirmesi: Proxy sunucuları, belirli bölgesel içerik gerektiren scraping görevleri için kritik olan farklı bölgelerden IP adresleri sağlayabilir. Örneğin, ABD'den ürün fiyat bilgisi alırken, yerel kullanıcı erişimini simüle etmek için bir ABD proxy IP'si kullanılabilir.

2. Web Scraping'de Proxylere Kullanma

Web crawling gibi, web scraping de bazı web sitelerindeki anti-scraping önlemlerini aşmak için proxy'lerden yararlanmalıdır. Özellikle büyük e-ticaret platformları, sosyal medya veya haber web siteleri üzerinde sık sık isteklerde bulunmak, hesap yasaklarına veya IP engellemelerine yol açabilir. Bu nedenle, proxy'ler veri çıkarımının sürekliliğini ve istikrarını sağlamak için önemlidir.

IP Yasaklarını Önleme: Scraping platformundaki veri hacmi çok büyük olduğunda, proxy kullanmak, yüksek frekanslı istekler nedeniyle hedef web sitesi tarafından yasaklanmaktan kaçınabilir.

Anti-Scraping Stratejilerini Aşma: Bazı web siteleri, IP, User-Agent, Cookie ve diğer bilgileri tespit ederek otomatik scraping davranışını tanımlar. Proxy kullanmak, dinamik olarak değişen IP'ler ve gerçek kullanıcı erişimini simüle ederek crawler olarak tanınma riskini azaltabilir.

Uygulama Senaryoları

1. E-Ticarette Gerçek Zamanlı Fiyat Ayarlama

E-ticaret devleri, otomatik fiyat ayarlamaları gerçekleştirmek için rakiplerinin envanterini ve fiyatlarını tarar. Bu, son derece yüksek frekans ve anti-engelleme yetenekleri gerektirir ve genellikle proxy IP'lerin kullanımını içerir.

2. Makine Öğrenimi ve AI Eğitimi

Mevcut LLM'ler (Büyük Dil Modelleri) olan GPT-4, büyük ölçekli web crawling'e dayanır. Wikipedia, akademik makaleler, haber raporları vb. gibi çok miktarda metni tarayarak modeller için öğrenme materyali sağlarlar.

3. Finansal Yatırım ve Kredi Değerlendirmesi

Hedge fonları, finansal performansı tahmin etmek için perakendecilerden satış verilerini veya lojistik bilgilerini tarar. Bankalar, risk kontrol değerlendirmeleri için şirketler hakkında kamuya açık dava bilgilerini tarayabilir.

Hukuki ve Etik: Dokunulmaz Kırmızı Çizgi

Crawling veya scraping olsun, işlemler yasal çerçeve içinde gerçekleştirilmelidir.

Telif Hakkı ve Mülkiyet: Veriler kamuya açık olsa da, büyük ölçekli scraping ve ticarileştirme, veri tabanı mülkiyetini ihlal edebilir.

Gizlilik Koruması: Kişisel gizlilik (PII) içeren verileri taramak kesinlikle yasaktır, örneğin yetkisiz kişisel kimlik numaraları, özel sohbet kayıtları vb.

Sunucu Yükü: Aşırı scraping frekansı, bir DDoS saldırısına eşdeğerdir ve hedef sunucunun çökmesine neden olabilir.

Sonuç

Artık web crawlers ve web scraping arasındaki farkları ve uygulamaları anlıyorsunuz.

IPDeep web crawling ve web scraping için yüksek kaliteli proxy IP'leri sunmaktadır, bunlar arasında:

ve dünya genelinde 200'den fazla ülke ve bölgeyi kapsayan 10 milyondan fazla yüksek kaliteli IP kaynağı ile çeşitli diğer proxy türleri. Şimdi bir hesap oluşturun ve proxy hizmetlerimizi ücretsiz denemek için başlayın!