웹 스크래핑과 웹 크롤링: 차이점 및 적용 사례

현대 인터넷의 발전에서 데이터의 수집과 활용은 점점 더 중요해지고 있습니다. 시장 분석, 뉴스 정보 수집, 과학 연구 데이터 지원 등 다양한 분야에서 웹 스크래핑(Web Scraping)과 웹 크롤링(Web Crawling) 기술이 널리 사용됩니다. 그러나 많은 사람들은 이 두 개념을 혼동하여 동일한 기술로 생각하는 경우가 많습니다. 사실, 웹 스크래핑과 웹 크롤링은 유사한 점이 있지만, 작동 원리, 적용 사례 및 기술적 세부 사항에서 차이가 있습니다. 이 글에서는 이 두 기술의 차이점을 심도 있게 탐구하고 각자의 적용 사례를 논의합니다.

웹 크롤링

1. 웹 크롤링이란 무엇인가?

웹 크롤러는 일반적으로 "스파이더(Spider)" 또는 "봇(Bot)"이라고 불리며, 그 핵심 임무는 발견과 인덱싱입니다. 이는 인터넷 미로를 탐험하는 탐험가와 같아서, 한 웹 페이지에서 출발하여 페이지의 링크를 클릭하여 다른 웹 페이지로 이동하며 반복합니다.

2. 크롤러의 작동 원리

크롤러는 특정한 표나 가격에 관심이 있는 것이 아니라, 구조와 관계에 더 관심을 둡니다.

시작점(Seed URL):주어진 URL에서 시작합니다.

링크 추출:페이지에서 모든 하이퍼링크를 식별합니다.

인덱스 업데이트:새로 발견된 페이지를 기록합니다.

프로토콜 준수:전문적인 크롤러는 웹사이트의 robots.txt 파일을 우선 읽어 어떤 영역에 접근할 수 있는지를 확인합니다.

3. 대표적인 사례

검색 엔진 (Google, Bing, Baidu):이는 크롤러의 가장 큰 응용입니다. 이들은 지속적으로 크롤링하여 검색 결과의 실시간성을 보장합니다.

웹사이트 건강 검사:웹사이트에 죽은 링크(404 오류)가 있는지 자동으로 검사합니다.

웹 스크래핑

1. 웹 스크래핑이란 무엇인가?

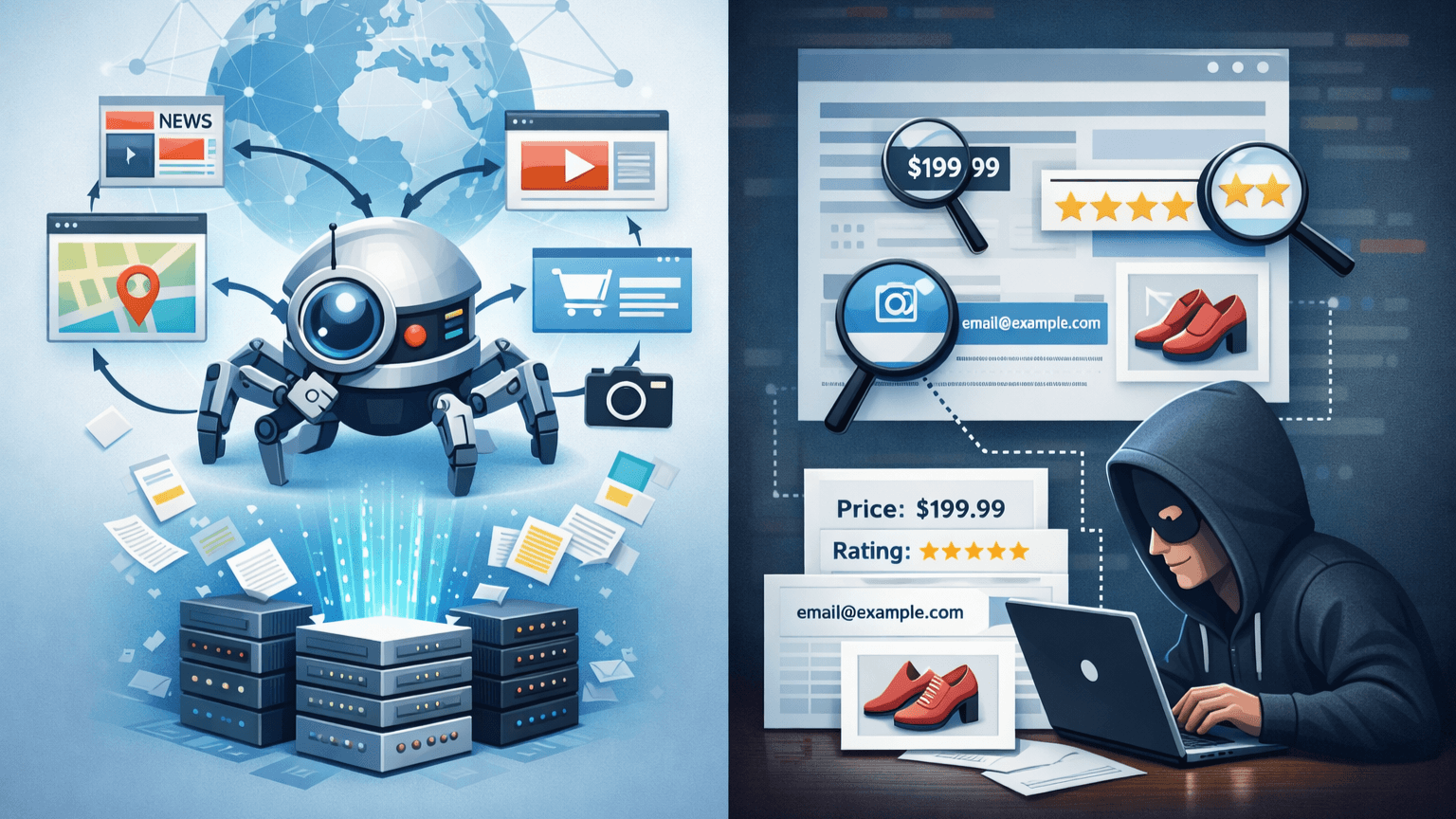

웹 스크래핑은 특정 데이터 추출의 과정입니다. 크롤러가 숲에서 지도를 그리는 것이라면, 스크래핑은 특정 나무 아래로 가서 그 특정 과일을 따는 것입니다.

2. 스크래핑의 작동 원리

스크래퍼는 일반적으로 특정 목표 웹 페이지에 맞춰 커스터마이즈됩니다.

HTML 파싱:웹 페이지의 소스 코드를 파싱하여(XPath, CSS 선택자 등 기술 사용), 필요한 데이터를 정확히 찾습니다.

데이터 정제:비구조적인 웹 콘텐츠를 구조화된 형식(예: JSON, CSV 또는 Excel)으로 변환합니다.

저장:추출된 전화번호, 제품 가격 또는 리뷰를 데이터베이스에 저장합니다.

3. 대표적인 사례

가격 모니터링:아마존이나 기타 전자상거래 플랫폼의 상품 가격을 스크래핑하여 입찰 전략에 사용합니다.

여론 분석:소셜 미디어에서 특정 키워드의 게시물을 스크래핑하여 대중의 감정을 분석합니다.

심층 비교: 스크래핑 vs 크롤링

두 기술의 차이를 더 명확하게 보여주기 위해 아래 표를 통해 비교할 수 있습니다:

| 차원 | 웹 크롤링 (Web Crawling) | 웹 스크래핑 (Web Scraping) |

|---|---|---|

| 핵심 목적 | 발견, 인덱싱, 검색, 지도 작성 | 데이터 추출, 변환, 저장, 분석 |

| 폭과 깊이 | 너비 우선, 수백만 개 도메인에 걸쳐 | 깊이 우선, 특정 페이지 또는 필드에 집중 |

| 기술 중심 | 링크 추출, 중복 제거, robots.txt 준수 | HTML 파싱, 반크롤링 전략 대응, 데이터 정제 |

| 결과 형태 | 인덱스 데이터베이스 구축 (Search Index) | 구조화된 파일 (CSV, JSON, SQL) |

| 전형적인 도구 | Apache Nutch, Scrapy (대량 모드) | Beautiful Soup, Selenium, Puppeteer |

이들은 어떻게 협력하여 작동하는가?

실제 대규모 프로젝트에서 스크래핑과 크롤링은 종종 "황금 파트너"로 작용합니다.

전국 범위의 부동산 분석 플랫폼을 구축한다고 상상해 보십시오:

크롤링 단계:당신은 크롤러를 작성하여 주요 부동산 중개 웹사이트를 탐색하고 모든 부동산 상세 페이지의 URL을 수집하여 이 URL을 큐에 저장합니다.

스크래핑 단계:당신은 이러한 상세 페이지에 대해 스크래퍼를 설계하여 각 페이지의 "가격", "평방미터 수", "지리적 위치" 및 "건축 연도"를 추출합니다.

스크래핑 효율성 향상 및 차단 우회

1. 웹 크롤링에서 프록시 사용

크롤러가 인터넷에서 대량의 페이지를 크롤링할 때, 대상 웹사이트는 빈번한 요청으로 인해 비정상적인 트래픽을 인식하고 IP를 차단할 수 있으며, 이로 인해 크롤링 프로세스가 중단될 수 있습니다. 이때 프록시를 사용하면 이 문제를 효과적으로 해결할 수 있습니다.

IP 회전:프록시 풀 관리를 통해 크롤러는 IP 주소를 지속적으로 변경하여 대상 웹사이트에서 비정상적인 트래픽으로 인식되는 것을 피할 수 있습니다. 프록시 풀은 많은프록시 IP로 구성된 집합체로, 크롤러는 이 중에서 무작위로 IP를 선택하여 요청을 보낼 수 있습니다.

IP 차단 우회:일부 웹사이트는 방문 빈도와 IP 주소의 출처에 따라 IP 차단 정책을 설정합니다. 프록시를 사용함으로써 크롤러는 이러한 제한을 우회하여 원활한 크롤링을 실현할 수 있습니다.

지역 및 언어 맞춤화:프록시 서버는 다양한 지역의 IP 주소를 제공할 수 있으며, 이는 특정 지역 콘텐츠를 크롤링하는 데 매우 중요합니다. 예를 들어, 미국 지역의 제품 가격 정보를 얻을 때는 미국 프록시 IP를 사용하여 현지 사용자의 접근을 시뮬레이션할 수 있습니다.

2. 웹 스크래핑에서 프록시 사용

웹 스크래핑과 웹 크롤링은 유사하며, 일부 웹사이트의 반크롤링 조치에 직면할 때도 프록시를 사용하여 우회해야 합니다. 특히 대형 전자상거래 플랫폼, 소셜 미디어 또는 뉴스 웹사이트를 스크래핑할 때 빈번한 요청이 계정 차단이나 IP 차단을 초래할 수 있습니다. 따라서 프록시는 데이터 추출의 연속성과 안정성을 보장합니다.

IP 차단 방지:크롤링 플랫폼의 데이터 양이 매우 방대할 때 프록시를 사용하면 높은 빈도의 요청으로 인해 대상 웹사이트에서 차단되는 것을 피할 수 있습니다.

반크롤링 전략 회피:일부 웹사이트는 IP, User-Agent, Cookie 등의 정보를 통해 자동화된 크롤링 행동을 식별합니다. 프록시를 사용하면 동적으로 IP를 변경하고 실제 사용자 접근을 시뮬레이션하여 크롤러로 인식될 위험을 줄일 수 있습니다.

응용 사례

1. 전자상거래의 실시간 가격 조정

전자상거래 대기업들은 경쟁사의 재고 및 가격을 스크래핑하여 알고리즘을 통해 자동으로 가격을 조정합니다. 이는 매우 높은 빈도와 차단 방지 능력이 필요하며, 일반적으로 프록시 IP의 사용이 포함됩니다.

2. 머신 러닝 및 AI 훈련

현재의 LLM(대형 언어 모델)인 GPT-4의 훈련은 대규모 웹 크롤링 없이는 불가능합니다. 이들은 위키백과, 학술 논문, 뉴스 보도 등 방대한 텍스트를 스크래핑하여 모델에 학습 자료를 제공합니다.

3. 금융 투자 및 신용 평가

헤지펀드는 소매업체의 판매 데이터나 물류 정보를 스크래핑하여 재무 성과를 예측합니다. 은행은 기업의 공개 소송 정보를 스크래핑하여 리스크 관리를 평가할 수 있습니다.

법률 및 윤리: 건드려서는 안 되는 금기

크롤링과 스크래핑 모두 법적 틀 내에서 운영되어야 합니다.

저작권 및 소유권:데이터는 공개되어 있지만, 대규모 스크래핑 및 상업화는 데이터베이스 소유권을 침해할 수 있습니다.

개인정보 보호:무단으로 개인 식별 정보(PII)를 포함한 데이터를 스크래핑하는 것은 금지됩니다. 예를 들어, 무단 개인 신분증 번호, 비밀 채팅 기록 등이 이에 해당합니다.

서버 부하:너무 높은 빈도의 스크래핑은 DDoS 공격과 동일하며, 대상 서버를 다운시킬 수 있습니다.

결론

이제 웹 크롤러와 웹 스크래핑의 차이점 및 응용을 이해하셨습니다.

IPDeep는 웹 크롤링 및 웹 스크래핑에 사용할 수 있는 고품질 프록시 IP를 제공합니다. 여기에는:

· 주거 프록시

· 모바일 프록시

등 다양한 프록시 유형이 있으며, 1000만 개 이상의 고품질 IP 자원을 보유하고 있으며, 전 세계 200개 이상의 국가 및 지역을 커버합니다. 지금 계정을 생성하고 무료로 우리의 프록시 서비스를 사용해 보세요!