網路數據新手指南:數據解析

在這個資訊爆炸的時代,數據無處不在。無論是瀏覽網頁、使用社交媒體,還是進行網購、查閱新聞,我們每天都在和海量數據打交道。但對於剛接觸網路數據的新手來說,一個問題常常令人困惑:當數據擺在眼前時,我們該如何讀懂它?這正是數據解析要解決的核心問題。

什麼是數據解析?

簡單來說,數據解析(Data Parsing)就是把原始數據轉換成「有結構、可使用的數據」的過程。

網路上的數據通常以HTML、JSON、XML等格式存在。這些數據本質上是文本,但它們內部有一定的規則。數據解析的任務,就是按照這些規則,把我們真正需要的資訊提取出來。

為什麼需要數據解析?

如果沒有數據解析,網路數據對電腦來說只是雜亂的文本。我們無法直接分析趨勢、統計數量或做進一步處理。

比如:

你想統計某個網站上所有商品的價格;你想獲取天氣接口返回的溫度數據;你想收集某類新聞的標題進行分析。

這些數據雖然都在網頁或接口裡,但必須經過解析,才能變成可操作的結構化內容,比如列表、字典或資料庫記錄。

數據解析的價值在於:

1. 提取有用資訊

2. 實現自動化處理

3. 支持數據分析和決策

常見的數據類型

作為新手,首先要認識幾種常見的數據格式。

1. HTML

HTML是網頁的基礎結構語言。當你打開一個網頁,瀏覽器看到的其實是HTML程式碼。

例如:

如果你只想獲取標題「今日新聞」,就需要通過解析HTML來提取 <h1> 標籤中的內容。

常用工具:BeautifulSoup、lxml 等。

2. JSON

JSON是一種非常流行的數據交換格式,很多API接口都會返回JSON數據。

例如:

通過解析後,我們就可以單獨訪問:

·name

·age

·city

在Python中可以使用 json 模組進行解析。

3. XML

XML和HTML結構類似,也是一種標籤結構的數據格式,常用於配置文件或某些接口。

數據解析的基本流程

無論數據來源是什麼,解析的過程通常包括以下幾個步驟:

第一步:獲取數據

數據可以來自網頁請求(如 requests 獲取的內容)、API接口、本地文件或資料庫等不同來源。

第二步:確定數據格式

在進行數據解析之前,需要先判斷數據屬於 HTML、JSON、XML 還是純文本等格式,因為不同的數據格式對應不同的解析方法。

第三步:提取目標資訊

透過選擇器、鍵名或標籤路徑等方式精準定位所需數據:

例如獲取所有商品價格標籤、提取 JSON 中的 “temperature” 欄位,或抓取某個 class 下的文本內容。

第四步:結構化存儲

解析後的數據可以存入列表、字典、CSV 文件、資料庫或 Excel 文件中,以便後續進行統計分析或視覺化處理。

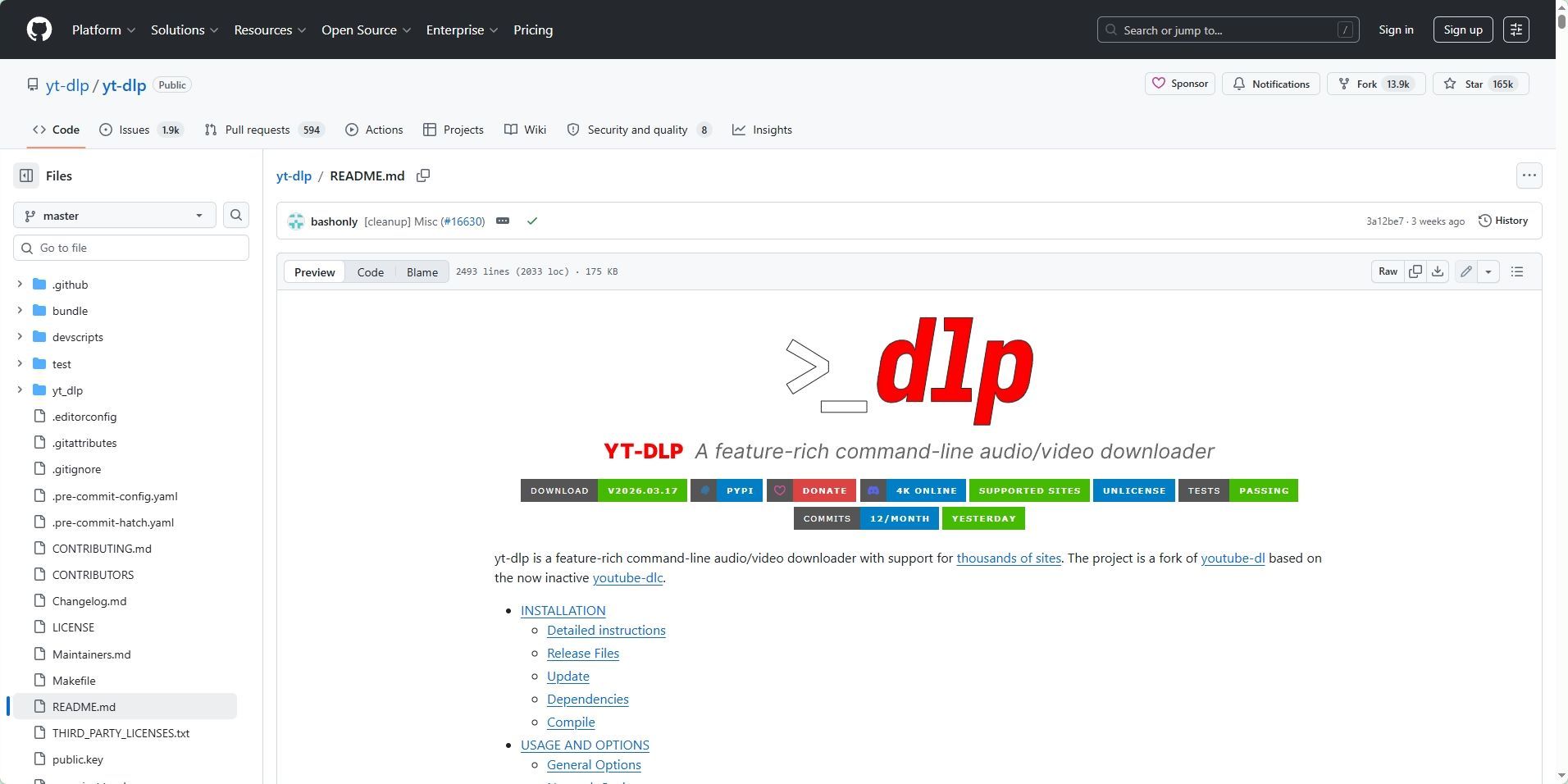

常見解析工具

1. Python內建json庫

適用於JSON解析。

優點:簡單、直接。

2. BeautifulSoup

適用於HTML解析。

優點:語法簡單、易上手、適合新手

3. lxml

性能更高,適合大規模數據解析。

4. 正則表達式(Regex)

適用於規則明確的文本匹配。

但不建議新手一開始過度依賴,因為複雜度較高。

數據解析中常見的問題

1. 頁面結構變化

網站一旦改版,HTML結構改變,原有解析規則可能失效。

解決方法:重新查看頁面結構,更新選擇器。

2. 編碼問題

有些數據包含中文或特殊字符,需要正確設置編碼格式。

3. 動態加載內容

某些網站數據透過JavaScript加載,直接請求HTML可能看不到數據。

這時可能需要使用:

·接口抓取

·瀏覽器自動化工具

結語

數據解析是網路數據處理的第一步,也是數據分析、人工智慧和自動化系統的重要基礎,它能夠幫助我們從大量無序的資訊中提取有價值的內容,將原始數據轉化為可分析和可利用的資訊。對於初學者來說,理解常見的數據格式,掌握基本的解析工具, 並持續進行實踐,是進入數據領域的重要步驟。當你能夠從一個網頁中成功提取出第一條數據時,就說明你已經具備了進行數據獲取和處理的基本能力。