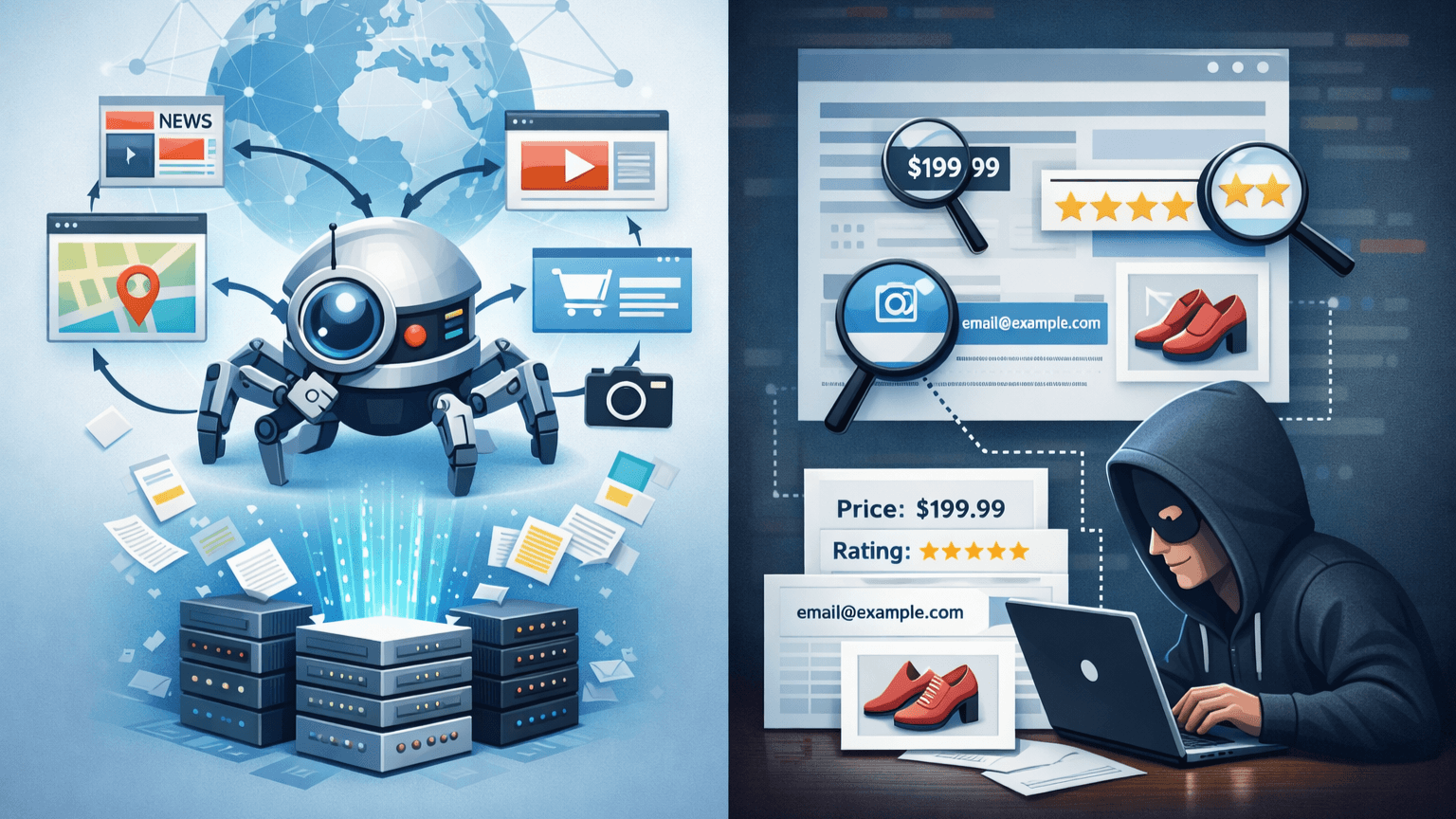

Веб-скрейпинг против веб-поиска: различия и области применения

В развитии современного интернета приобретение и использование данных становятся все более важными. Будь то для анализа рынка, получения новостной информации или предоставления данных для научных исследований, веб-скрейпинг и веб-поиск — это две технологии, которые часто широко используются. Однако многие люди путают эти два понятия, думая, что это одна и та же технология. На самом деле, хотя веб-скрейпинг и веб-поиск имеют сходства, их принципы работы, сценарии применения и технические детали различаются. Эта статья углубится в различия между ними и обсудит их соответствующие сценарии применения.

Веб-поиск

1. Что такое веб-поиск?

Веб-поиск, часто называемый "пауком" или "ботом", имеет основной задачей открытие и индексацию. Он действует как исследователь, который перемещается по лабиринту интернета, начиная с одной веб-страницы и переходя к другой, щелкая по ссылкам на странице, повторяя цикл.

2. Как работают поисковые роботы

Поисковые роботы не заботятся о конкретных таблицах или ценах; их больше интересует структура и взаимосвязи.

Начальный URL: Начинается с заданного URL.

Извлечение ссылок: Определяет все гиперссылки на странице.

Обновление индекса: Записывает вновь обнаруженные страницы.

Следование протоколам: Профессиональные поисковые роботы придают приоритет чтению файла robots.txt сайта, чтобы подтвердить, какие области разрешены для доступа.

3. Представительные случаи

Поисковые системы (Google, Bing, Baidu): Это самое масштабное применение поисковых роботов. Они постоянно сканируют, чтобы обеспечить актуальность результатов поиска.

Проверка состояния сайта: Автоматически проверяет наличие битых ссылок (ошибки 404) на сайте.

Веб-скрейпинг

1. Что такое веб-скрейпинг?

Веб-скрейпинг — это процесс извлечения конкретных данных. Если веб-поиск похож на картографирование леса, то веб-скрейпинг — это прямое обращение к конкретному дереву, чтобы собрать этот конкретный фрукт.

2. Как работает веб-скрейпинг

Скрейперы обычно настраиваются для конкретных целевых веб-страниц.

Парсинг HTML: Путем парсинга исходного кода веб-страницы (с использованием XPath, CSS селектора и т.д.) точно находят необходимые данные.

Очистка данных: Преобразует неструктурированный контент веб-страницы в структурированный формат (например, JSON, CSV или Excel).

Хранение: Сохраняет извлеченные номера телефонов, цены на продукты или комментарии в базе данных.

3. Представительные случаи

Мониторинг цен: Извлекает цены на продукты с Amazon или других платформ электронной коммерции для стратегий торгов.

Анализ настроений: Извлекает посты с конкретными ключевыми словами из социальных сетей для анализа общественного мнения.

Сравнение: скрейпинг против поиска

Чтобы наглядно проиллюстрировать различия между двумя, мы можем сравнить их в таблице ниже:

| Размерность | Веб-поиск | Веб-скрейпинг |

|---|---|---|

| Основная цель | Открытие, индексация, поиск, картирование | Извлечение, преобразование, хранение, анализ данных |

| Ширина против глубины | Ширина, охватывающая миллионы доменов | Глубина, сосредоточенная на конкретных страницах или полях |

| Технический фокус | Извлечение ссылок, дедупликация, следование robots.txt | Парсинг HTML, стратегии противодействия скрейпингу, очистка данных |

| Формат результата | Индексная база данных (поисковый индекс) | Структурированные файлы (CSV, JSON, SQL) |

| Типичные инструменты | Apache Nutch, Scrapy (пакетный режим) | Beautiful Soup, Selenium, Puppeteer |

Как они работают вместе?

В крупных проектах веб-скрейпинг и веб-поиск часто работают как "золотая пара".

Представьте, что вы строите платформу для анализа недвижимости по всей стране:

Этап поиска: Вы пишете поискового робота, который прыгает по основным сайтам агентств недвижимости, собирая URL всех страниц с деталями объектов и сохраняя эти URL в очереди.

Этап скрейпинга: Вы разрабатываете скрейпер для этих страниц с деталями, специально извлекая "цену", "квадратные метры", "местоположение" и "год постройки" с каждой страницы.

Повышение эффективности скрейпинга и обход блокировок

1. Использование прокси в веб-поиске

Когда поисковые роботы обширно сканируют страницы в интернете, целевой сайт может выявить аномальный трафик из-за частых запросов и заблокировать IP, что приводит к остановке процесса скрейпинга. В таких случаях использование прокси может эффективно решить эту проблему.

Ротация IP: Управляя пулом прокси, поисковые роботы могут постоянно менять IP-адреса, чтобы избежать идентификации как аномального трафика целевым сайтом. Пул прокси — это коллекция множества прокси IP, из которой поисковые роботы могут случайным образом выбирать IP для запросов.

Обход блокировок IP: Некоторые сайты устанавливают политики блокировки IP на основе частоты доступа и источника IP-адресов. Используя прокси, поисковые роботы могут обойти эти ограничения для беспрепятственного скрейпинга.

Региональная и языковая настройка: Прокси-серверы могут предоставлять IP-адреса из разных регионов, что имеет решающее значение для задач скрейпинга, требующих конкретного регионального контента. Например, при получении информации о ценах на продукты из США можно использовать прокси IP из США для имитации доступа местного пользователя.

2. Использование прокси в веб-скрейпинге

Подобно веб-поиску, веб-скрейпинг также должен использовать прокси для обхода мер противодействия скрейпингу на некоторых сайтах. Особенно при скрейпинге крупных платформ электронной коммерции, социальных сетей или новостных сайтов частые запросы могут привести к блокировке аккаунтов или IP. Поэтому прокси могут обеспечить непрерывность и стабильность извлечения данных.

Предотвращение блокировок IP: Когда объем данных на платформе скрейпинга очень велик, использование прокси может избежать блокировки целевым сайтом из-за частых запросов.

Избежание стратегий противодействия скрейпингу: Некоторые сайты идентифицируют автоматическое поведение скрейпинга, обнаруживая IP, User-Agent, Cookie и другую информацию. Использование прокси может снизить риск быть распознанным как поисковый робот, динамически меняя IP и имитируя доступ реального пользователя.

Сценарии применения

1. Корректировка цен в реальном времени в электронной коммерции

Гиганты электронной коммерции сканируют запасы и цены конкурентов, чтобы реализовать автоматическую корректировку цен с использованием алгоритмов. Это требует крайне высокой частоты и возможностей противодействия блокировкам, часто включая использование прокси IP.

2. Машинное обучение и обучение ИИ

Современные LLM (модели больших языков), такие как GPT-4, полагаются на масштабный веб-поиск. Они извлекают огромные объемы текста из Википедии, научных статей, новостных отчетов и т.д., предоставляя учебный материал для моделей.

3. Финансовые инвестиции и оценка кредитоспособности

Хедж-фонды извлекают данные о продажах или логистической информации от розничных продавцов, чтобы предсказать финансовые результаты. Банки могут извлекать общедоступную информацию о судебных разбирательствах компаний для оценки рисков.

Юридические и этические аспекты: неприкосновенная красная линия

Будь то поиск или скрейпинг, операции должны проводиться в рамках правовой системы.

Авторские права и право собственности: Хотя данные являются общедоступными, масштабный скрейпинг и коммерциализация могут нарушать право собственности на базы данных.

Защита конфиденциальности: Извлечение данных, касающихся личной конфиденциальности (PII), строго запрещено, например, несанкционированные личные номера, частные записи чатов и т.д.

Нагрузка на сервер: Чрезмерная частота скрейпинга эквивалентна DDoS-атаке, что может привести к сбою целевого сервера.

Заключение

Теперь вы понимаете различия и применения веб-роботов и веб-скрейпинга.

IPDeep предоставляет качественные прокси IP для веб-поиска и веб-скрейпинга, включая:

и различные другие типы прокси, с более чем 10 миллионами качественных IP-ресурсов, охватывающих более 200 стран и регионов мира. Создайте аккаунт сейчас, чтобы попробовать наши прокси-сервисы бесплатно!