Web Scraping vs Web Crawling: Diferenças e Casos de Uso

No desenvolvimento da internet moderna, a aquisição e utilização de dados tornaram-se cada vez mais importantes. Seja para análise de mercado, obtenção de informações de notícias ou fornecimento de suporte de dados para pesquisa científica, web scraping e web crawling são duas tecnologias que são frequentemente amplamente utilizadas. No entanto, muitas pessoas confundem os conceitos dessas duas, pensando que são a mesma tecnologia. Na verdade, embora web scraping e web crawling tenham semelhanças, seus princípios de funcionamento, cenários de aplicação e detalhes técnicos diferem. Este artigo irá aprofundar as diferenças entre os dois e discutir seus respectivos cenários de aplicação.

Web Crawling

1. O que é Web Crawling?

Web crawling, frequentemente referido como "spider" ou "bot," tem a tarefa central de descobrir e indexar. Ele atua como um explorador navegando pelo labirinto da internet, começando de uma página da web e pulando para outra clicando em links na página, repetindo o ciclo.

2. Como os Crawlers Funcionam

Os crawlers não se preocupam com tabelas ou preços específicos; eles estão mais preocupados com a estrutura e os relacionamentos.

URL Semente: Começa a partir de uma URL dada.

Extrair Links: Identifica todos os hyperlinks na página.

Atualizar Índice: Registra páginas recém-descobertas.

Seguir Protocolos: Crawlers profissionais priorizam a leitura do arquivo robots.txt do site para confirmar quais áreas são permitidas para acesso.

3. Casos Representativos

Motores de Busca (Google, Bing, Baidu): Esta é a aplicação mais grandiosa dos crawlers. Eles rastejam continuamente para garantir a atualidade dos resultados de busca.

Verificação de Saúde do Site: Verifica automaticamente se há links quebrados (erros 404) no site.

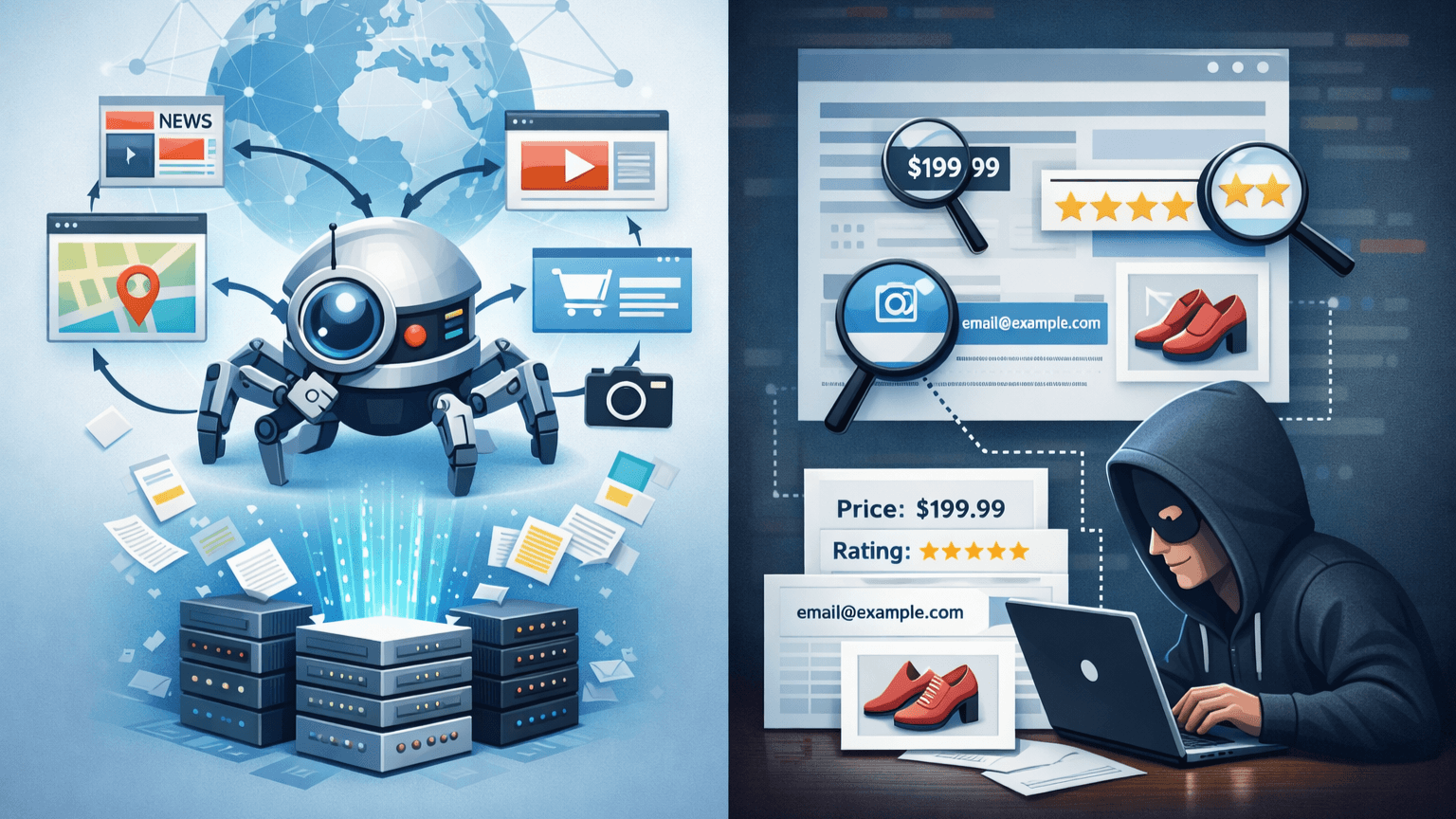

Web Scraping

1. O que é Web Scraping?

Web scraping é o processo de extrair dados específicos. Se crawling é como mapear uma floresta, scraping é ir diretamente a uma árvore específica para pegar aquele fruto particular.

2. Como o Scraping Funciona

Scrapers são geralmente personalizados para páginas da web-alvo específicas.

Parse HTML: Ao analisar o código-fonte da página da web (usando XPath, CSS Selector, etc.), localize com precisão os dados necessários.

Limpeza de Dados: Converte o conteúdo não estruturado da página da web em um formato estruturado (como JSON, CSV ou Excel).

Armazenamento: Armazena números de telefone, preços de produtos ou comentários extraídos em um banco de dados.

3. Casos Representativos

Monitoramento de Preços: Extrai preços de produtos da Amazon ou outras plataformas de e-commerce para estratégias de licitação.

Análise de Sentimentos: Extrai postagens com palavras-chave específicas das redes sociais para analisar o sentimento público.

Comparação Detalhada: Scraping vs Crawling

Para ilustrar claramente as diferenças entre os dois, podemos compará-los na tabela abaixo:

| Dimensão | Web Crawling | Web Scraping |

|---|---|---|

| Propósito Principal | Descobrir, indexar, pesquisar, mapear | Extrair, transformar, armazenar, analisar dados |

| Amplitude vs Profundidade | Amplitude-primeiro, abrangendo milhões de domínios | Profundidade-primeiro, focando em páginas ou campos específicos |

| Foco Técnico | Extração de links, deduplicação, seguindo robots.txt | Análise HTML, estratégias anti-scraping, limpeza de dados |

| Formato do Resultado | Banco de dados de índice (Índice de Busca) | Arquivos estruturados (CSV, JSON, SQL) |

| Ferramentas Típicas | Apache Nutch, Scrapy (modo em massa) | Beautiful Soup, Selenium, Puppeteer |

Como Eles Trabalham Juntos?

Em projetos de grande escala, scraping e crawling frequentemente trabalham como um "par perfeito."

Imagine que você está construindo uma plataforma de análise imobiliária em todo o país:

Fase de Crawling: Você escreve um crawler que salta por sites de grandes agências imobiliárias, coletando as URLs de todas as páginas de detalhes de propriedades e armazenando essas URLs em uma fila.

Fase de Scraping: Você projeta um scraper para essas páginas de detalhes, extraindo especificamente "preço," "metros quadrados," "localização," e "ano de construção" de cada página.

Aumentando a Eficiência do Scraping e Contornando Bloqueios

1. Usando Proxies em Web Crawling

Quando crawlers raspam páginas extensivamente na internet, o site alvo pode identificar tráfego anormal devido a solicitações frequentes e bloquear o IP, fazendo com que o processo de scraping pare. Nesses casos, usar proxies pode resolver efetivamente esse problema.

Rotação de IP: Ao gerenciar um pool de proxies, crawlers podem mudar continuamente os endereços IP para evitar serem identificados como tráfego anormal pelo site alvo. Um pool de proxies é uma coleção de numerosos IPs de proxy dos quais os crawlers podem selecionar aleatoriamente IPs para solicitações.

Contornando Bloqueios de IP: Alguns sites definem políticas de bloqueio de IP com base na frequência de acesso e na origem dos endereços IP. Ao usar proxies, crawlers podem contornar essas restrições para um scraping contínuo.

Personalização Regional e de Idioma: Servidores proxy podem fornecer endereços IP de diferentes regiões, o que é crucial para tarefas de scraping que requerem conteúdo regional específico. Por exemplo, ao obter informações sobre preços de produtos dos EUA, um IP proxy dos EUA pode ser usado para simular o acesso de um usuário local.

2. Usando Proxies em Web Scraping

Semelhante ao web crawling, o web scraping também precisa aproveitar proxies para contornar medidas anti-scraping em alguns sites. Especialmente ao raspar grandes plataformas de e-commerce, redes sociais ou sites de notícias, solicitações frequentes podem levar a banimentos de conta ou bloqueios de IP. Portanto, proxies podem garantir a continuidade e estabilidade da extração de dados.

Evitando Banimentos de IP: Quando o volume de dados na plataforma de scraping é muito grande, usar proxies pode evitar ser banido pelo site alvo devido a solicitações de alta frequência.

Evitando Estratégias Anti-Scraping: Alguns sites identificam comportamentos de scraping automatizados detectando IP, User-Agent, Cookie e outras informações. Usar proxies pode reduzir o risco de ser reconhecido como um crawler, mudando dinamicamente os IPs e simulando o acesso de usuários reais.

Cenários de Aplicação

1. Ajuste de Preços em Tempo Real em E-Commerce

Gigantes do e-commerce raspam o inventário e os preços dos concorrentes para implementar ajustes automáticos de preços usando algoritmos. Isso requer uma frequência extremamente alta e capacidades anti-bloqueio, frequentemente envolvendo o uso de IPs de proxy.

2. Aprendizado de Máquina e Treinamento de IA

Os LLMs atuais (Modelos de Linguagem Grande) como o GPT-4 dependem de crawling em larga escala. Eles raspam vastas quantidades de texto da Wikipedia, artigos acadêmicos, relatórios de notícias, etc., fornecendo material de aprendizado para os modelos.

3. Investimento Financeiro e Avaliação de Crédito

Fundos de hedge raspam dados de vendas ou informações logísticas de varejistas para prever o desempenho financeiro. Bancos podem raspar informações de litígios publicamente disponíveis sobre empresas para avaliações de controle de risco.

Legal e Ético: A Linha Vermelha Intocável

Seja crawling ou scraping, as operações devem ser conduzidas dentro da estrutura legal.

Direitos Autorais e Propriedade: Embora os dados sejam públicos, scraping em larga escala e comercialização podem infringir a propriedade do banco de dados.

Proteção de Privacidade: Raspagem de dados envolvendo privacidade pessoal (PII) é estritamente proibida, como números de identificação pessoal não autorizados, registros de chat privados, etc.

Carga do Servidor: Frequência excessiva de scraping é equivalente a um ataque DDoS, o que pode causar a queda do servidor alvo.

Conclusão

Agora você entende as diferenças e aplicações de crawlers da web e web scraping.

IPDeep fornece IPs de proxy de alta qualidade para web crawling e web scraping, incluindo:

e vários outros tipos de proxies, com mais de 10 milhões de recursos de IP de alta qualidade cobrindo mais de 200 países e regiões em todo o mundo. Crie uma conta agora para experimentar nossos serviços de proxy gratuitamente!