Web Scraping vs Web Crawling : Différences et Cas d'Utilisation

Dans le développement de l'internet moderne, l'acquisition et l'utilisation des données sont devenues de plus en plus importantes. Que ce soit pour l'analyse de marché, l'obtention d'informations d'actualité ou la fourniture de soutien aux données pour la recherche scientifique, le web scraping et le web crawling sont deux technologies souvent largement utilisées. Cependant, beaucoup de gens confondent les concepts de ces deux technologies, pensant qu'il s'agit de la même technologie. En fait, bien que le web scraping et le web crawling aient des similitudes, leurs principes de fonctionnement, leurs scénarios d'application et leurs détails techniques diffèrent. Cet article approfondira les différences entre les deux et discutera de leurs scénarios d'application respectifs.

Web Crawling

1. Qu'est-ce que le Web Crawling ?

Le web crawling, souvent appelé "araignée" ou "bot", a pour tâche principale de découvrir et d'indexer. Il agit comme un explorateur naviguant à travers le labyrinthe de l'internet, commençant par une page web et sautant à une autre en cliquant sur des liens sur la page, répétant le cycle.

2. Comment fonctionnent les Crawlers

Les crawlers ne se soucient pas des tableaux ou des prix spécifiques ; ils s'intéressent davantage à la structure et aux relations.

URL de départ : Commence à partir d'une URL donnée.

Extraire des liens : Identifie tous les hyperliens sur la page.

Mettre à jour l'index : Enregistre les pages nouvellement découvertes.

Suivre les protocoles : Les crawlers professionnels priorisent la lecture du fichier robots.txt du site web pour confirmer quelles zones sont autorisées à l'accès.

3. Cas représentatifs

Moteurs de recherche (Google, Bing, Baidu) : C'est l'application la plus grandiose des crawlers. Ils crawlent en continu pour assurer la pertinence des résultats de recherche.

Vérification de la santé du site web : Vérifie automatiquement s'il y a des liens morts (erreurs 404) sur le site web.

Web Scraping

1. Qu'est-ce que le Web Scraping ?

Le web scraping est le processus d'extraction de données spécifiques. Si le crawling est comme cartographier une forêt, le scraping consiste à aller directement à un arbre spécifique pour cueillir ce fruit particulier.

2. Comment fonctionne le Scraping

Les scrapers sont généralement personnalisés pour des pages web cibles spécifiques.

Analyser le HTML : En analysant le code source de la page web (en utilisant XPath, CSS Selector, etc.), localisez avec précision les données requises.

Nettoyage des données : Convertit le contenu non structuré de la page web en un format structuré (tel que JSON, CSV ou Excel).

Stockage : Stocke les numéros de téléphone extraits, les prix des produits ou les commentaires dans une base de données.

3. Cas représentatifs

Surveillance des prix : Extrait les prix des produits d'Amazon ou d'autres plateformes de commerce électronique pour des stratégies d'enchères.

Analyse de sentiment : Extrait des publications avec des mots-clés spécifiques des réseaux sociaux pour analyser le sentiment public.

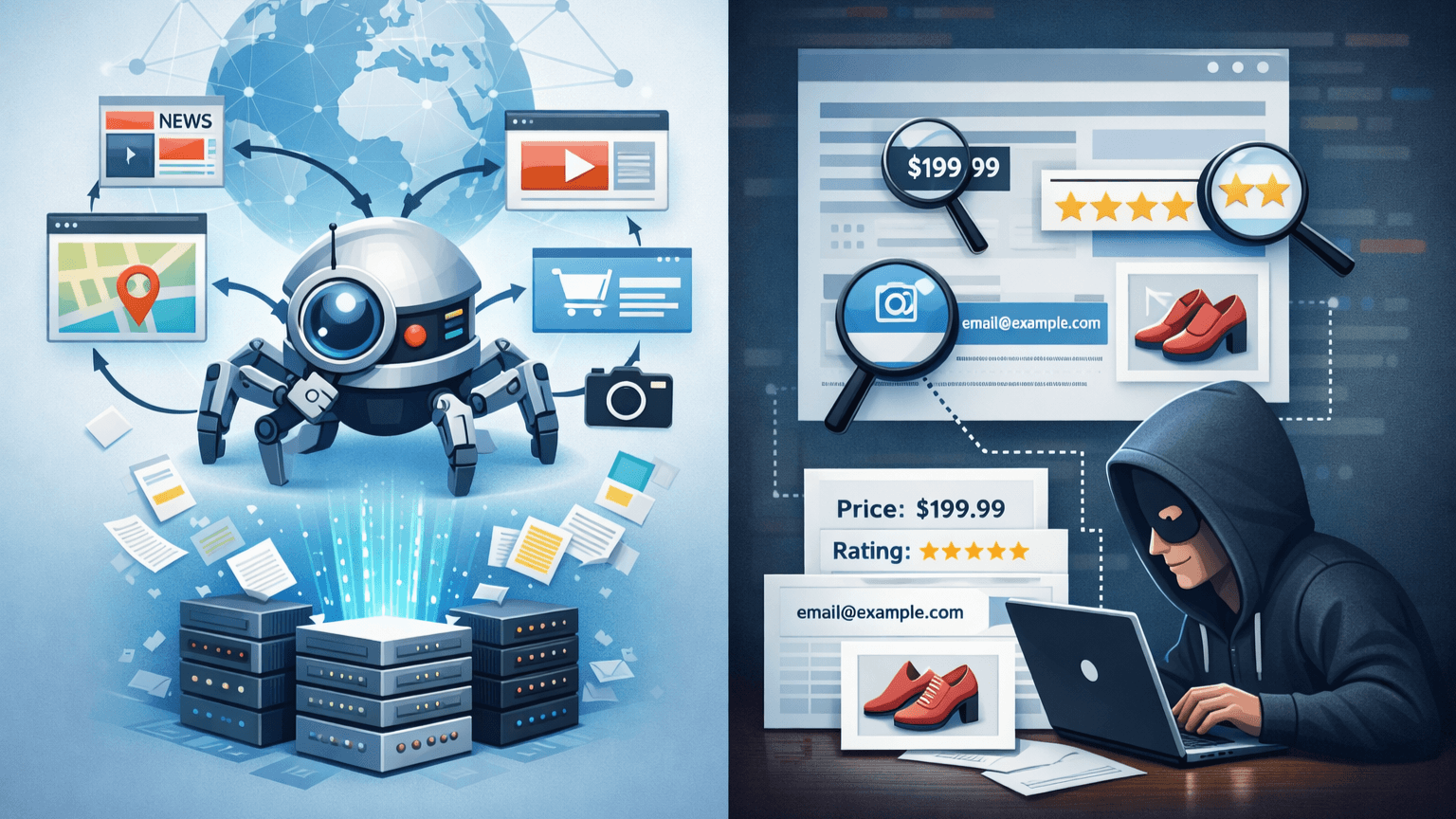

Comparaison Approfondie : Scraping vs Crawling

Pour illustrer clairement les différences entre les deux, nous pouvons les comparer dans le tableau ci-dessous :

| Dimension | Web Crawling | Web Scraping |

|---|---|---|

| Objectif principal | Découvrir, indexer, rechercher, cartographier | Extraire, transformer, stocker, analyser des données |

| Largeur vs Profondeur | Largeur d'abord, couvrant des millions de domaines | Profondeur d'abord, se concentrant sur des pages ou des champs spécifiques |

| Focus technique | Extraction de liens, dé-duplication, suivi du robots.txt | Analyse HTML, stratégies anti-scraping, nettoyage des données |

| Format de résultat | Base de données d'index (Index de recherche) | Fichiers structurés (CSV, JSON, SQL) |

| Outils typiques | Apache Nutch, Scrapy (mode en masse) | Beautiful Soup, Selenium, Puppeteer |

Comment fonctionnent-ils ensemble ?

Dans les projets à grande échelle, le scraping et le crawling fonctionnent souvent comme un "pair d'or".

Imaginez que vous construisez une plateforme d'analyse immobilière à l'échelle nationale :

Phase de Crawling : Vous écrivez un crawler qui saute à travers les principaux sites web d'agences immobilières, collectant les URL de toutes les pages de détails des propriétés et stockant ces URL dans une file d'attente.

Phase de Scraping : Vous concevez un scraper pour ces pages de détails, extrayant spécifiquement "prix", "mètres carrés", "emplacement" et "année de construction" de chaque page.

Améliorer l'efficacité du scraping et contourner les blocages

1. Utiliser des Proxies dans le Web Crawling

Lorsque les crawlers scrutent des pages de manière extensive sur internet, le site web cible peut identifier un trafic anormal en raison de demandes fréquentes et bloquer l'IP, ce qui entraîne l'arrêt du processus de scraping. Dans de tels cas, l'utilisation de proxies peut résoudre efficacement ce problème.

Rotation d'IP : En gérant un pool de proxies, les crawlers peuvent changer continuellement d'adresses IP pour éviter d'être identifiés comme un trafic anormal par le site web cible. Un pool de proxies est une collection de nombreux IP proxy à partir desquels les crawlers peuvent sélectionner aléatoirement des IP pour les demandes.

Contourner les blocages d'IP : Certains sites web mettent en place des politiques de blocage d'IP basées sur la fréquence d'accès et la source des adresses IP. En utilisant des proxies, les crawlers peuvent contourner ces restrictions pour un scraping sans faille.

Personnalisation régionale et linguistique : Les serveurs proxy peuvent fournir des adresses IP de différentes régions, ce qui est crucial pour les tâches de scraping nécessitant un contenu régional spécifique. Par exemple, lors de l'obtention d'informations sur les prix des produits aux États-Unis, une IP proxy américaine peut être utilisée pour simuler un accès utilisateur local.

2. Utiliser des Proxies dans le Web Scraping

Tout comme le web crawling, le web scraping doit également tirer parti des proxies pour contourner les mesures anti-scraping sur certains sites web. Surtout lors du scraping de grandes plateformes de commerce électronique, de réseaux sociaux ou de sites d'actualités, des demandes fréquentes peuvent entraîner des interdictions de compte ou des blocages d'IP. Par conséquent, les proxies peuvent garantir la continuité et la stabilité de l'extraction de données.

Prévenir les interdictions d'IP : Lorsque le volume de données sur la plateforme de scraping est très important, l'utilisation de proxies peut éviter d'être interdit par le site web cible en raison de demandes à haute fréquence.

Éviter les stratégies anti-scraping : Certains sites web identifient le comportement de scraping automatisé en détectant l'IP, l'User-Agent, les cookies et d'autres informations. L'utilisation de proxies peut réduire le risque d'être reconnu comme un crawler en changeant dynamiquement d'IP et en simulant un accès utilisateur réel.

Scénarios d'application

1. Ajustement des prix en temps réel dans le commerce électronique

Les géants du commerce électronique scrutent les stocks et les prix des concurrents pour mettre en œuvre des ajustements automatiques des prix à l'aide d'algorithmes. Cela nécessite une fréquence extrêmement élevée et des capacités anti-blocage, impliquant souvent l'utilisation d'IP proxy.

2. Apprentissage automatique et formation de l'IA

Les LLM actuels (Modèles de Langage de Grande Taille) comme GPT-4 reposent sur un crawling web à grande échelle. Ils extraient d'énormes quantités de texte de Wikipedia, d'articles académiques, de rapports d'actualités, etc., fournissant du matériel d'apprentissage pour les modèles.

3. Investissement financier et évaluation de crédit

Les fonds spéculatifs extraient des données de vente ou des informations logistiques des détaillants pour prédire la performance financière. Les banques peuvent extraire des informations sur les litiges publiquement disponibles concernant des entreprises pour des évaluations de contrôle des risques.

Légal et Éthique : La Ligne Rouge Inviolable

Que ce soit pour le crawling ou le scraping, les opérations doivent être menées dans le cadre légal.

Droit d'auteur et propriété : Bien que les données soient publiques, le scraping à grande échelle et la commercialisation peuvent enfreindre la propriété des bases de données.

Protection de la vie privée : Le scraping de données impliquant la vie privée personnelle (PII) est strictement interdit, comme les numéros d'identification personnelle non autorisés, les enregistrements de chat privés, etc.

Charge du serveur : Une fréquence de scraping excessive équivaut à une attaque DDoS, ce qui peut provoquer un crash du serveur cible.

Conclusion

Vous comprenez maintenant les différences et les applications des crawlers web et du web scraping.

IPDeep fournit des IP proxy de haute qualité pour le web crawling et le web scraping, y compris :

· Proxies de Centre de Données

et divers autres types de proxies, avec plus de 10 millions de ressources IP de haute qualité couvrant plus de 200 pays et régions dans le monde. Créez un compte maintenant pour essayer nos services de proxy gratuitement !