Web Scraping vs Web Crawling: Diferencias y Casos de Uso

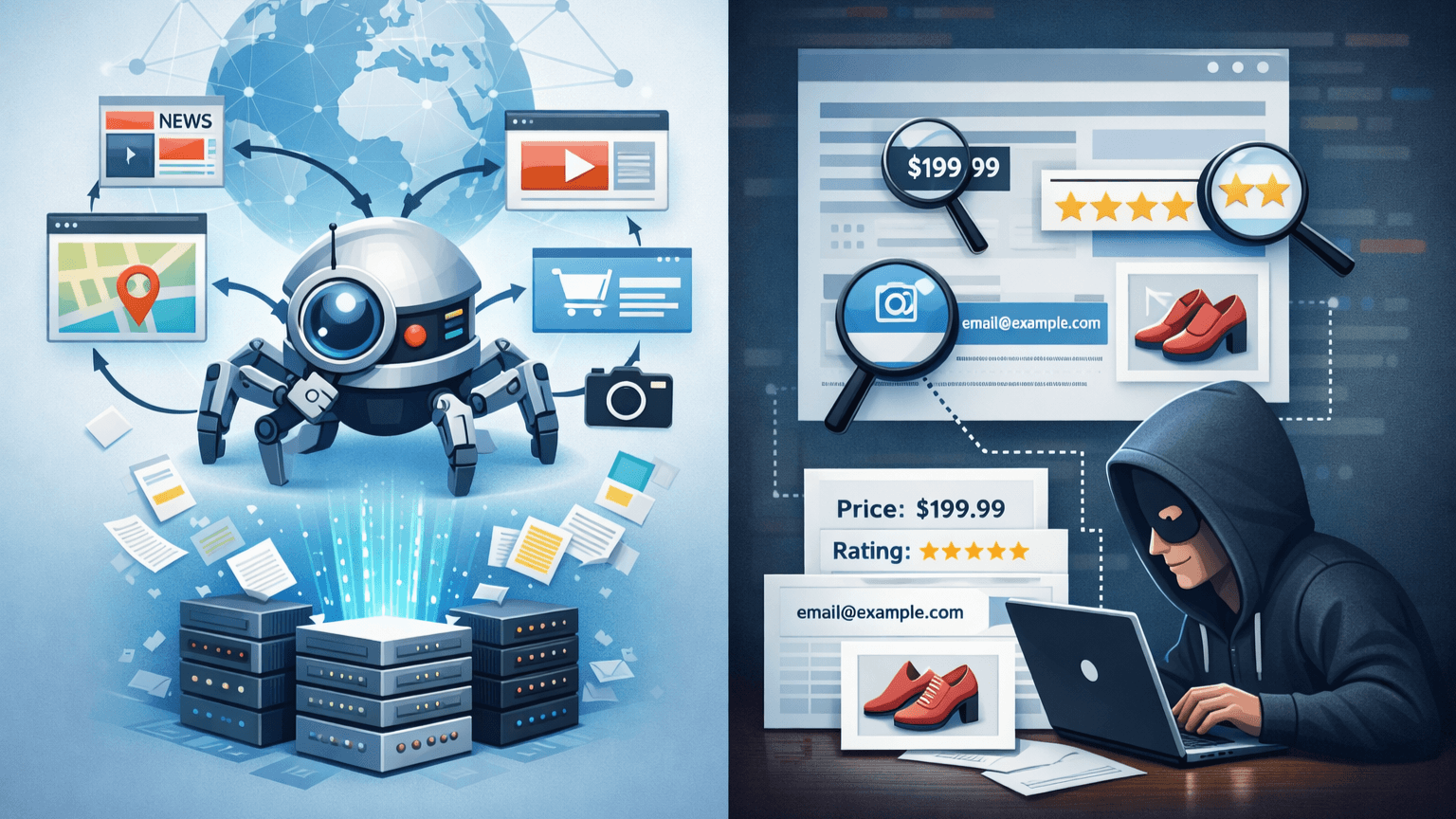

En el desarrollo de Internet moderno, la adquisición y utilización de datos se ha vuelto cada vez más importante. Ya sea para análisis de mercado, obtención de información de noticias o proporcionar soporte de datos para la investigación científica, el web scraping y el web crawling son dos tecnologías que a menudo se utilizan ampliamente. Sin embargo, muchas personas confunden los conceptos de estas dos, pensando que son la misma tecnología. De hecho, aunque el web scraping y el web crawling tienen similitudes, sus principios de funcionamiento, escenarios de aplicación y detalles técnicos difieren. Este artículo profundizará en las diferencias entre los dos y discutirá sus respectivos escenarios de aplicación.

Web Crawling

1. ¿Qué es el Web Crawling?

El web crawling, a menudo denominado "araña" o "bot," tiene la tarea principal de descubrir e indexar. Actúa como un explorador navegando a través del laberinto de Internet, comenzando desde una página web y saltando a otra al hacer clic en los enlaces de la página, repitiendo el ciclo.

2. Cómo Funcionan los Crawlers

Los crawlers no se preocupan por tablas o precios específicos; están más interesados en la estructura y las relaciones.

URL Semilla: Comienza desde una URL dada.

Extraer Enlaces: Identifica todos los hipervínculos en la página.

Actualizar Índice: Registra las páginas recién descubiertas.

Seguir Protocolos: Los crawlers profesionales priorizan leer el robots.txt del sitio web para confirmar qué áreas están permitidas para el acceso.

3. Casos Representativos

Motores de Búsqueda (Google, Bing, Baidu): Esta es la aplicación más grandiosa de los crawlers. Crawlean continuamente para asegurar la actualidad de los resultados de búsqueda.

Chequeo de Salud del Sitio Web: Verifica automáticamente si hay enlaces rotos (errores 404) en el sitio web.

Web Scraping

1. ¿Qué es el Web Scraping?

El web scraping es el proceso de extraer datos específicos. Si el crawling es como mapear un bosque, el scraping es ir directamente a un árbol específico para recoger ese fruto particular.

2. Cómo Funciona el Scraping

Los scrapers suelen estar personalizados para páginas web específicas.

Parsear HTML: Al parsear el código fuente de la página web (usando XPath, CSS Selector, etc.), localizar con precisión los datos requeridos.

Limpieza de Datos: Convierte el contenido no estructurado de la página web en un formato estructurado (como JSON, CSV o Excel).

Almacenamiento: Almacena números de teléfono extraídos, precios de productos o comentarios en una base de datos.

3. Casos Representativos

Monitoreo de Precios: Extrae precios de productos de Amazon u otras plataformas de comercio electrónico para estrategias de puja.

Análisis de Sentimientos: Extrae publicaciones con palabras clave específicas de redes sociales para analizar el sentimiento público.

Comparación en Profundidad: Scraping vs Crawling

Para ilustrar claramente las diferencias entre los dos, podemos compararlos en la tabla a continuación:

| Dimensión | Web Crawling | Web Scraping |

|---|---|---|

| Propósito Principal | Descubrir, indexar, buscar, mapear | Extraer, transformar, almacenar, analizar datos |

| Amplitud vs Profundidad | Amplitud primero, abarcando millones de dominios | Profundidad primero, enfocándose en páginas o campos específicos |

| Enfoque Técnico | Extracción de enlaces, deduplicación, siguiendo robots.txt | Parseo de HTML, estrategias anti-scraping, limpieza de datos |

| Formato de Resultado | Base de datos de índice (Índice de Búsqueda) | Archivos estructurados (CSV, JSON, SQL) |

| Herramientas Típicas | Apache Nutch, Scrapy (modo masivo) | Beautiful Soup, Selenium, Puppeteer |

¿Cómo Trabajan Juntas?

En proyectos a gran escala, el scraping y el crawling a menudo trabajan como un "par dorado."

Imagina que estás construyendo una plataforma de análisis inmobiliario a nivel nacional:

Fase de Crawling: Escribes un crawler que salta a través de los principales sitios web de agencias inmobiliarias, recopilando las URL de todas las páginas de detalles de propiedades y almacenando estas URL en una cola.

Fase de Scraping: Diseñas un scraper para estas páginas de detalles, extrayendo específicamente "precio," "metros cuadrados," "ubicación," y "año de construcción" de cada página.

Mejorando la Eficiencia del Scraping y Evitando Bloqueos

1. Uso de Proxies en el Web Crawling

Cuando los crawlers scrapean páginas extensivamente en Internet, el sitio web objetivo puede identificar tráfico anormal debido a solicitudes frecuentes y bloquear la IP, causando que el proceso de scraping se detenga. En tales casos, el uso de proxies puede resolver efectivamente este problema.

Rotación de IP: Al gestionar un grupo de proxies, los crawlers pueden cambiar continuamente las direcciones IP para evitar ser identificados como tráfico anormal por el sitio web objetivo. Un grupo de proxies es una colección de numerosos IPs proxy de las cuales los crawlers pueden seleccionar IPs aleatorias para las solicitudes.

Evitando Bloqueos de IP: Algunos sitios web establecen políticas de bloqueo de IP basadas en la frecuencia de acceso y la fuente de las direcciones IP. Al usar proxies, los crawlers pueden eludir estas restricciones para un scraping sin problemas.

Personalización Regional y de Idioma: Los servidores proxy pueden proporcionar direcciones IP de diferentes regiones, lo cual es crucial para tareas de scraping que requieren contenido regional específico. Por ejemplo, al obtener información sobre precios de productos de EE. UU., se puede usar una IP proxy de EE. UU. para simular el acceso de un usuario local.

2. Uso de Proxies en el Web Scraping

Similar al web crawling, el web scraping también necesita aprovechar proxies para eludir las medidas anti-scraping en algunos sitios web. Especialmente al scrapeo de grandes plataformas de comercio electrónico, redes sociales o sitios de noticias, solicitudes frecuentes pueden llevar a bloqueos de cuentas o IP. Por lo tanto, los proxies pueden asegurar la continuidad y estabilidad de la extracción de datos.

Previniendo Bloqueos de IP: Cuando el volumen de datos en la plataforma de scraping es muy grande, usar proxies puede evitar ser bloqueado por el sitio web objetivo debido a solicitudes de alta frecuencia.

Evitando Estrategias Anti-Scraping: Algunos sitios web identifican el comportamiento de scraping automatizado al detectar IP, User-Agent, Cookie y otra información. Usar proxies puede reducir el riesgo de ser reconocido como un crawler al cambiar dinámicamente las IPs y simular el acceso de un usuario real.

Escenarios de Aplicación

1. Ajuste de Precios en Tiempo Real en Comercio Electrónico

Los gigantes del comercio electrónico scrapean el inventario y precios de los competidores para implementar ajustes automáticos de precios utilizando algoritmos. Esto requiere una frecuencia extremadamente alta y capacidades anti-bloqueo, a menudo involucrando el uso de IPs proxy.

2. Aprendizaje Automático y Entrenamiento de IA

Los modelos de lenguaje grande actuales (LLMs) como GPT-4 dependen del crawling web a gran escala. Extraen grandes cantidades de texto de Wikipedia, artículos académicos, informes de noticias, etc., proporcionando material de aprendizaje para los modelos.

3. Inversión Financiera y Evaluación de Crédito

Los fondos de cobertura scrapean datos de ventas o información logística de minoristas para predecir el rendimiento financiero. Los bancos pueden scrapean información sobre litigios públicamente disponibles sobre empresas para evaluaciones de control de riesgos.

Legal y Ético: La Línea Roja Intocable

Ya sea crawling o scraping, las operaciones deben llevarse a cabo dentro del marco legal.

Derechos de Autor y Propiedad: Aunque los datos son públicos, el scraping a gran escala y la comercialización pueden infringir la propiedad de la base de datos.

Protección de la Privacidad: Scraping de datos que involucran privacidad personal (PII) está estrictamente prohibido, como números de identificación personal no autorizados, registros de chat privados, etc.

Carga del Servidor: Una frecuencia excesiva de scraping es equivalente a un ataque DDoS, lo que puede causar que el servidor objetivo se bloquee.

Conclusión

Ahora entiendes las diferencias y aplicaciones de los crawlers web y el web scraping.

IPDeep proporciona IPs proxy de alta calidad para web crawling y web scraping, incluyendo:

y varios otros tipos de proxies, con más de 10 millones de recursos de IP de alta calidad cubriendo más de 200 países y regiones en todo el mundo. ¡Crea una cuenta ahora para probar nuestros servicios de proxy gratis!