網頁抓取與網頁爬蟲:區別與應用場景

在現代互聯網的發展中,數據的獲取和利用變得越來越重要。無論是進行市場分析、獲取新聞資訊,還是為科學研究提供數據支持,網頁抓取(Web Scraping)與網頁爬蟲(Web Crawling)這兩種技術常常被廣泛使用。然而,很多人對這兩者的概念存在一些混淆,認為它們是同一種技術。事實上,網頁抓取與網頁爬蟲雖然有相似之處,但它們的工作原理、應用場景以及技術細節卻有所不同。本文將深入探討這兩者的區別,並討論它們各自的應用場景。

網頁爬蟲

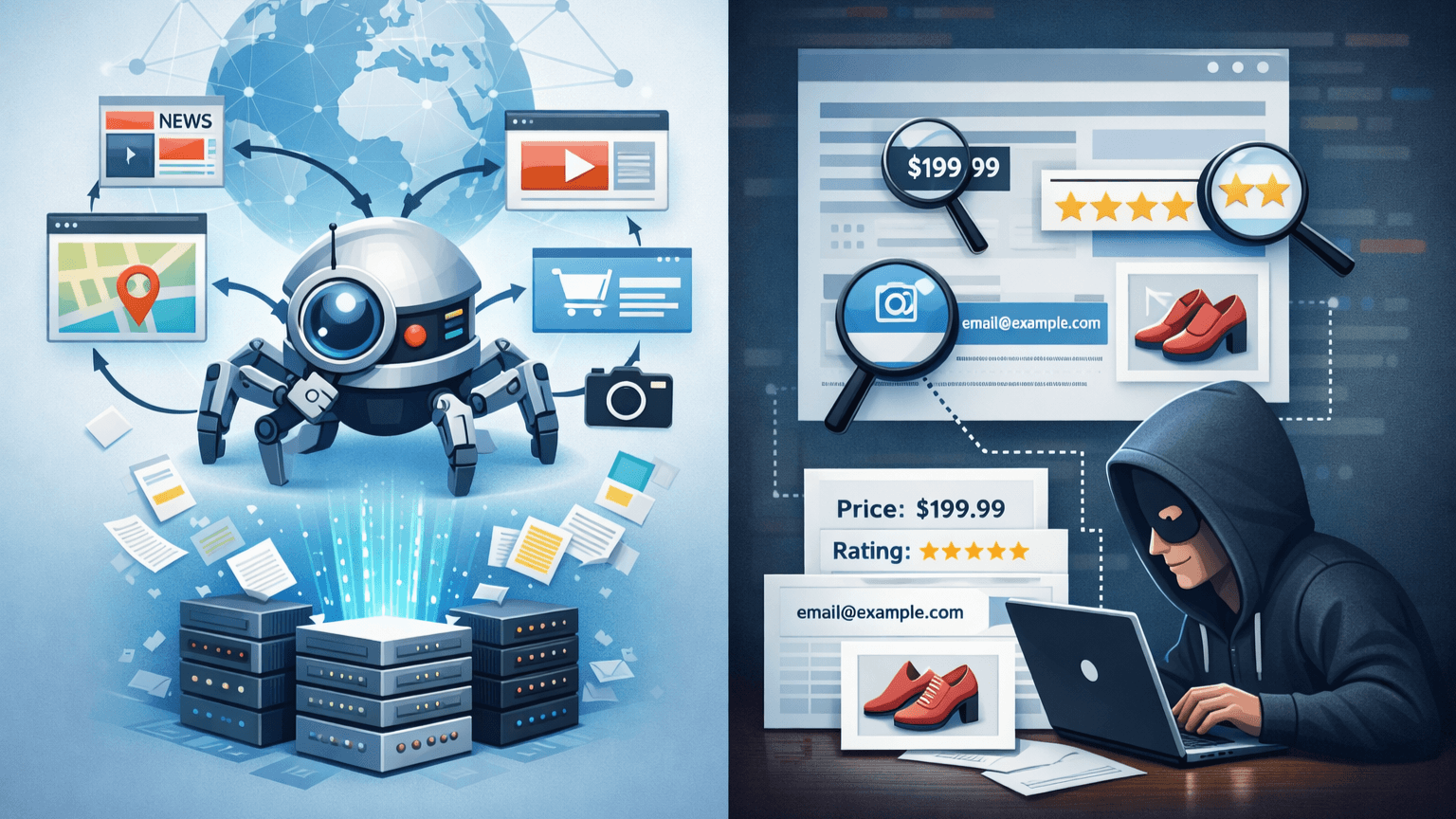

1. 什麼是網頁爬蟲?

網頁爬蟲,通常被稱為"蜘蛛(Spider)"或"機器人(Bot)",其核心任務是發現與索引。它像是一個在互聯網迷宮中穿梭的探險家,從一個網頁出發,通過點擊頁面上的鏈接跳轉到另一個網頁,循環往復。

2. 爬蟲的工作原理

爬蟲並不在意某個具體的表格或價格,它更關心的是結構與關係。

起始點(Seed URL):從給定的網址開始。

提取鏈接:識別頁面上所有的超鏈接(Hyperlinks)。

更新索引:將新發現的頁面記錄在案。

遵守協議:專業的爬蟲會優先讀取網站的 robots.txt 文件,確認哪些區域是允許進入的。

3. 代表性案例

搜索引擎(Google, Bing, Baidu):這是爬蟲最宏大的應用。它們持續不斷地爬行,以確保搜索結果的實時性。

網站健康檢查:自動檢查網站是否存在死鏈(404錯誤)。

網頁抓取

1. 什麼是網頁抓取?

網頁抓取是特定數據提取的過程。如果說爬蟲是在森林裡畫地圖,抓取就是直接走到某棵樹下採摘那顆特定的果實。

2. 抓取的工作原理

抓取器通常針對特定的目標網頁進行定制。

解析 HTML:通過解析網頁的源代碼(使用 XPath、CSS Selector 等技術),精確定位需要的數據。

數據清洗:將非結構化的網頁內容轉化為結構化的格式(如 JSON、CSV 或 Excel)。

存儲:將提取出的電話號碼、產品價格或評論存入數據庫。

3. 代表性案例

價格監控:抓取亞馬遜或其他電商平台的商品價格,用於競價策略。

輿情分析:從社交媒體抓取特定關鍵詞的帖子,分析公眾情緒。

深度對比:抓取 vs 爬蟲

為了更清晰地展示兩者的區別,我們可以通過下表進行對比:

| 維度 | 網頁爬蟲 (Web Crawling) | 網頁抓取 (Web Scraping) |

|---|---|---|

| 核心目的 | 發現、索引、搜索、畫地圖 | 提取、轉化、存儲、分析數據 |

| 廣度與深度 | 廣度優先,跨越數百萬個域名 | 深度優先,聚焦於特定頁面或字段 |

| 技術重心 | 鏈接提取、去重、遵守 robots.txt | HTML 解析、反爬策略應對、數據清洗 |

| 結果形式 | 建立索引數據庫 (Search Index) | 結構化文件 (CSV, JSON, SQL) |

| 典型工具 | Apache Nutch, Scrapy (大批量模式) | Beautiful Soup, Selenium, Puppeteer |

它們是如何協同工作的?

在實際的大型項目中,抓取和爬蟲往往是一對"黃金搭檔"。

想像你要建立一個全國範圍內的房地產分析平台:

爬蟲階段:你編寫一個爬蟲,在各大房產中介網站上跳轉,搜集所有房源詳情頁的 URL,並把這些 URL 存入隊列。

抓取階段:你針對這些詳情頁設計一個抓取器,專門提取每一頁中的"價格"、"平米數"、"地理位置"和"建造年份"。

提升抓取效率與繞過封禁

1. 在網頁爬蟲中使用代理

當爬蟲在互聯網上大量抓取頁面時,目標網站可能會因為頻繁的請求識別到異常流量並封禁IP,導致抓取過程無法繼續進行。這時,使用代理可以有效解決這個問題。

IP輪換:通過代理池管理,爬蟲可以不斷更換IP地址,以避免被目標網站識別為異常流量。代理池是由大量代理IP組成的集合,爬蟲可以從中隨機選擇IP進行請求。

突破IP封鎖:一些網站會根據訪問頻率和IP地址的來源,設置IP封禁策略。通過使用代理,爬蟲能夠突破這些限制,實現無縫抓取。

地區和語言定制:代理服務器可以提供來自不同地區的IP地址,這對於需要抓取特定地區內容的抓取任務至關重要。例如,獲取美國地區的產品價格信息時,可以使用美國代理IP,模擬本地用戶的訪問。

2. 在網頁抓取中使用代理

網頁抓取和網頁爬蟲類似,在面對一些網站的反爬蟲措施時,也需要借助代理來進行繞過。尤其是抓取大型電商平台、社交媒體或新聞網站時,頻繁的請求可能會導致賬戶封禁或IP封鎖。因此,代理能夠保障數據提取的連續性和穩定性。

防止IP封禁:當抓取平台的數據量非常龐大時,使用代理能夠避免因為高頻率請求而被目標網站封禁。

避免反爬蟲策略:一些網站通過檢測IP、User-Agent、Cookie等信息來識別是否為自動化抓取行為。使用代理可以通過動態更換IP、模擬真實用戶訪問,降低被識別為爬蟲的風險。

應用場景

1. 電子商務的實時調價

電商巨頭們通過抓取對手的庫存和價格,利用算法實現自動調價。這需要極高的頻率和抗封禁能力,通常涉及代理 IP的使用。

2. 機器學習與 AI 訓練

當前的 LLM(大語言模型)如 GPT-4 的訓練,離不開大規模的網頁爬蟲。它們抓取了維基百科、學術論文、新聞報導等海量文本,為模型提供了學習素材。

3. 金融投資與信用評估

對沖基金會抓取零售商的銷量數據或物流信息,以預測財報表現。銀行則可能抓取企業的公開涉訴信息進行風控評估。

法律與倫理:不可觸碰的紅線

無論是爬蟲還是抓取,都必須在法律框架內運行。

版權與所有權:雖然數據是公開的,但大規模抓取並商業化可能侵犯數據庫所有權。

隱私保護:嚴禁抓取涉及個人隱私(PII)的數據,如未經授權的個人身份證號、私密聊天記錄等。

伺服器負載:過高頻率的抓取等同於 DDoS 攻擊,會導致目標伺服器宕機。

總結

現在你已經了解了網頁爬蟲和網頁抓取的區別與應用。

IPDeep提供可用於網頁爬蟲和網頁抓取的高質量代理IP,包括:

· 住宅代理

· 數據中心代理

· 移動代理

等多種代理類型,擁有超過1000萬個高質量IP資源,覆蓋全球200+國家和地區。立即創建賬號,免費試用我們的代理服務吧!