Web Scraping vs Web Crawling: Unterschiede und Anwendungsfälle

In der Entwicklung des modernen Internets sind Datenerfassung und -nutzung zunehmend wichtig geworden. Ob für Marktanalysen, um Nachrichteninformationen zu erhalten oder um Datenunterstützung für wissenschaftliche Forschungen bereitzustellen, Web Scraping und Web Crawling sind zwei Technologien, die oft weit verbreitet sind. Viele Menschen verwechseln jedoch die Konzepte dieser beiden und denken, sie seien dieselbe Technologie. Tatsächlich haben Web Scraping und Web Crawling zwar Ähnlichkeiten, unterscheiden sich jedoch in ihren Arbeitsprinzipien, Anwendungsszenarien und technischen Details. Dieser Artikel wird die Unterschiede zwischen den beiden vertiefen und ihre jeweiligen Anwendungsszenarien diskutieren.

Web Crawling

1. Was ist Web Crawling?

Web Crawling, oft als "Spider" oder "Bot" bezeichnet, hat die Hauptaufgabe, zu entdecken und zu indizieren. Es agiert wie ein Entdecker, der durch das Labyrinth des Internets navigiert, beginnend von einer Webseite und zu einer anderen springt, indem es Links auf der Seite anklickt und den Zyklus wiederholt.

2. Wie Crawlers Arbeiten

Crawler kümmern sich nicht um spezifische Tabellen oder Preise; sie sind mehr an Struktur und Beziehungen interessiert.

Seed-URL: Beginnt von einer gegebenen URL.

Links extrahieren: Identifiziert alle Hyperlinks auf der Seite.

Index aktualisieren: Protokolliert neu entdeckte Seiten.

Protokolle befolgen: Professionelle Crawler priorisieren das Lesen der robots.txt-Datei der Website, um zu bestätigen, welche Bereiche für den Zugriff erlaubt sind.

3. Repräsentative Fälle

Suchmaschinen (Google, Bing, Baidu): Dies ist die größte Anwendung von Crawlern. Sie crawlen kontinuierlich, um die Aktualität der Suchergebnisse sicherzustellen.

Website-Gesundheitscheck: Überprüft automatisch, ob es tote Links (404-Fehler) auf der Website gibt.

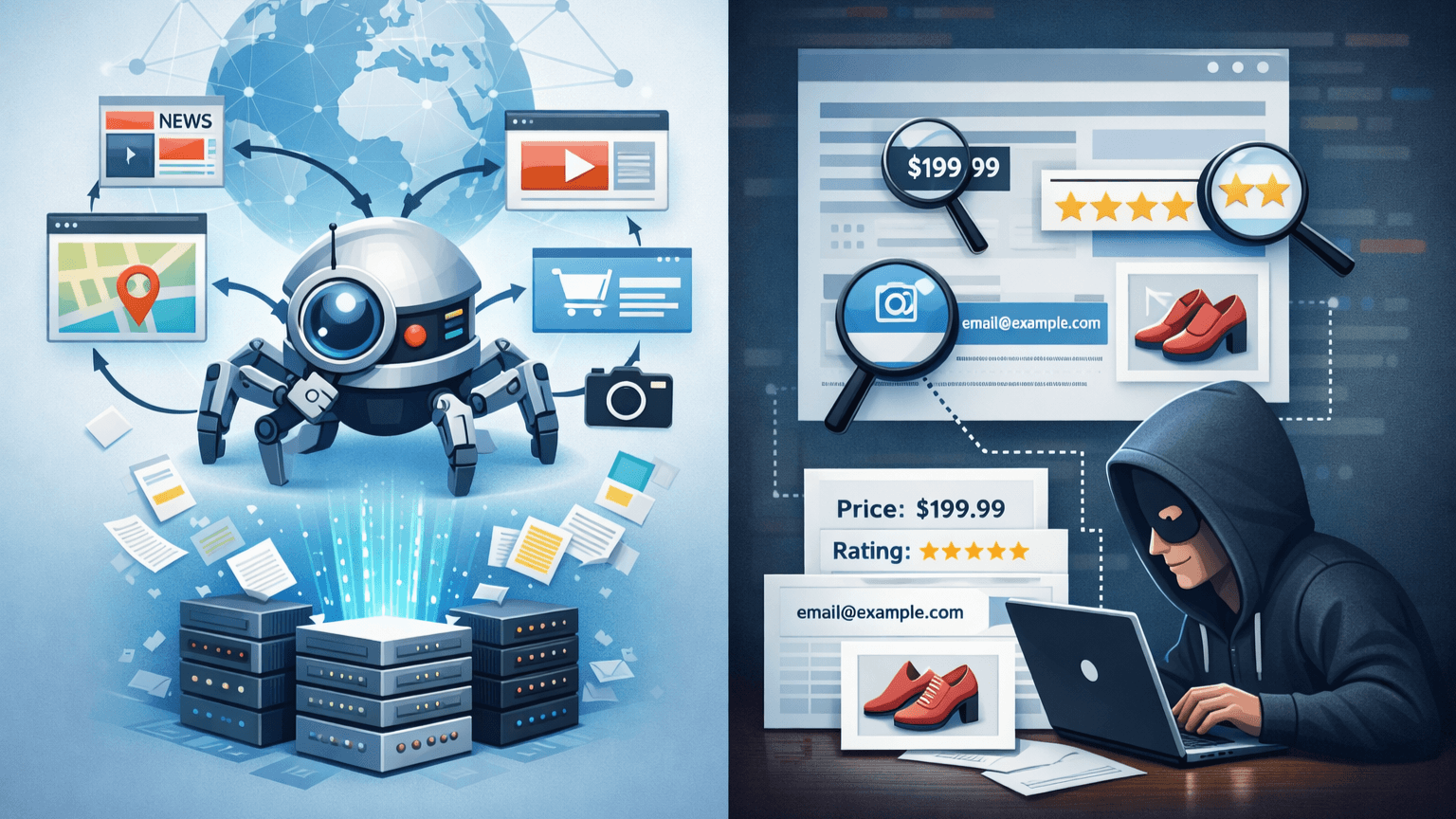

Web Scraping

1. Was ist Web Scraping?

Web Scraping ist der Prozess des Extrahierens spezifischer Daten. Wenn Crawling wie das Kartieren eines Waldes ist, ist Scraping das direkte Gehen zu einem bestimmten Baum, um diese spezielle Frucht zu pflücken.

2. Wie Scraping funktioniert

Scraper sind normalerweise für spezifische Zielwebseiten angepasst.

HTML parsen: Durch das Parsen des Quellcodes der Webseite (unter Verwendung von XPath, CSS-Selektor usw.) wird die erforderliche Daten genau lokalisiert.

Datenbereinigung: Wandelt unstrukturierte Webseiteninhalte in ein strukturiertes Format (wie JSON, CSV oder Excel) um.

Speicherung: Speichert extrahierte Telefonnummern, Produktpreise oder Kommentare in einer Datenbank.

3. Repräsentative Fälle

Preismonitoring: Scrapt Produktpreise von Amazon oder anderen E-Commerce-Plattformen für Bietstrategien.

Sentiment-Analyse: Scrapt Beiträge mit spezifischen Schlüsselwörtern aus sozialen Medien, um die öffentliche Stimmung zu analysieren.

Detaillierter Vergleich: Scraping vs Crawling

Um die Unterschiede zwischen den beiden klar zu veranschaulichen, können wir sie in der folgenden Tabelle vergleichen:

| Dimension | Web Crawling | Web Scraping |

|---|---|---|

| Kernzweck | Entdecken, indizieren, suchen, kartieren | Extrahieren, transformieren, speichern, analysieren von Daten |

| Breite vs Tiefe | Breitensuche, spanning Millionen von Domains | Tiefensuche, Fokus auf spezifische Seiten oder Felder |

| Technischer Fokus | Linkextraktion, Duplikatentfernung, Befolgung von robots.txt | HTML-Parsing, Anti-Scraping-Strategien, Datenbereinigung |

| Ergebnisformat | Indexdatenbank (Suchindex) | Strukturierte Dateien (CSV, JSON, SQL) |

| Typische Werkzeuge | Apache Nutch, Scrapy (Bulk-Modus) | Beautiful Soup, Selenium, Puppeteer |

Wie arbeiten sie zusammen?

In großangelegten Projekten arbeiten Scraping und Crawling oft als "goldenes Paar."

Stellen Sie sich vor, Sie bauen eine landesweite Immobilienanalyseplattform auf:

Crawling-Phase: Sie schreiben einen Crawler, der über die wichtigsten Immobilienagentur-Websites springt, die URLs aller Immobilien-Detailseiten sammelt und diese URLs in einer Warteschlange speichert.

Scraping-Phase: Sie entwerfen einen Scraper für diese Detailseiten, der speziell "Preis", "Quadratmeter", "Standort" und "Baujahr" von jeder Seite extrahiert.

Effizienz des Scraping verbessern und Blockaden umgehen

1. Verwendung von Proxys im Web Crawling

Wenn Crawler Seiten umfassend im Internet scrapen, kann die Zielwebsite abnormale Verkehrsströme aufgrund häufiger Anfragen identifizieren und die IP blockieren, was den Scraping-Prozess zum Stillstand bringt. In solchen Fällen kann die Verwendung von Proxys dieses Problem effektiv lösen.

IP-Rotation: Durch die Verwaltung eines Proxy-Pools können Crawler ihre IP-Adressen kontinuierlich ändern, um zu vermeiden, dass sie von der Zielwebsite als abnormaler Verkehr identifiziert werden. Ein Proxy-Pool ist eine Sammlung zahlreicher Proxy-IPs aus denen Crawler zufällig IPs für Anfragen auswählen können.

Umgehen von IP-Blockaden: Einige Websites setzen IP-Blockierungsrichtlinien basierend auf Zugriffsfrequenz und der Quelle der IP-Adressen. Durch die Verwendung von Proxys können Crawler diese Einschränkungen umgehen, um nahtlos zu scrapen.

Regionale und sprachliche Anpassung: Proxy-Server können IP-Adressen aus verschiedenen Regionen bereitstellen, was für Scraping-Aufgaben, die spezifische regionale Inhalte erfordern, entscheidend ist. Wenn beispielsweise Produktpreisinformationen aus den USA abgerufen werden, kann eine US-Proxy-IP verwendet werden, um den Zugriff eines lokalen Benutzers zu simulieren.

2. Verwendung von Proxys im Web Scraping

Ähnlich wie beim Web Crawling muss auch beim Web Scraping auf Proxys zurückgegriffen werden, um Anti-Scraping-Maßnahmen auf einigen Websites zu umgehen. Besonders beim Scraping großer E-Commerce-Plattformen, sozialer Medien oder Nachrichten-Websites können häufige Anfragen zu Kontosperrungen oder IP-Blockaden führen. Daher können Proxys die Kontinuität und Stabilität der Datenerfassung gewährleisten.

Verhindern von IP-Sperren: Wenn das Datenvolumen auf der Scraping-Plattform sehr groß ist, können Proxys verhindern, dass die Zielwebsite aufgrund von Hochfrequenzanfragen gesperrt wird.

Umgehen von Anti-Scraping-Strategien: Einige Websites identifizieren automatisierte Scraping-Verhalten, indem sie IP, User-Agent, Cookie und andere Informationen erkennen. Die Verwendung von Proxys kann das Risiko verringern, als Crawler erkannt zu werden, indem IPs dynamisch geändert und der Zugriff echter Benutzer simuliert wird.

Anwendungsszenarien

1. Echtzeit-Preisänderung im E-Commerce

E-Commerce-Riesen scrapen die Bestände und Preise von Wettbewerbern, um automatische Preisänderungen mithilfe von Algorithmen umzusetzen. Dies erfordert extrem hohe Frequenz und Anti-Blockierungsfähigkeiten, oft unter Verwendung von Proxy-IPs.

2. Maschinelles Lernen und KI-Training

Aktuelle LLMs (Large Language Models) wie GPT-4 basieren auf großangelegtem Web Crawling. Sie scrapen riesige Mengen an Text aus Wikipedia, wissenschaftlichen Arbeiten, Nachrichtenberichten usw., um Lernmaterial für die Modelle bereitzustellen.

3. Finanzinvestitionen und Kreditbewertung

Hedgefonds scrapen Verkaufsdaten oder Logistikinformationen von Einzelhändlern, um die finanzielle Leistung vorherzusagen. Banken können öffentlich verfügbare Rechtsstreitinformationen über Unternehmen scrapen, um Risikokontrollbewertungen durchzuführen.

Rechtlich und ethisch: Die unantastbare rote Linie

Ob Crawling oder Scraping, die Operationen müssen im rechtlichen Rahmen durchgeführt werden.

Urheberrecht und Eigentum: Obwohl Daten öffentlich sind, kann großangelegtes Scraping und Kommerzialisierung gegen das Eigentum an Datenbanken verstoßen.

Datenschutz: Das Scraping von Daten, die persönliche Privatsphäre (PII) betreffen, ist strengstens untersagt, wie z.B. unbefugte persönliche ID-Nummern, private Chatprotokolle usw.

Serverlast: Eine übermäßige Scraping-Frequenz ist gleichbedeutend mit einem DDoS-Angriff, der den Zielserver zum Absturz bringen kann.

Fazit

Jetzt verstehen Sie die Unterschiede und Anwendungen von Web-Crawlern und Web-Scraping.

IPDeep bietet hochwertige Proxy-IPs für Web Crawling und Web Scraping an, darunter:

und verschiedene andere Arten von Proxys, mit über 10 Millionen hochwertigen IP-Ressourcen, die mehr als 200 Länder und Regionen weltweit abdecken. Erstellen Sie jetzt ein Konto, um unsere Proxy-Dienste kostenlos auszuprobieren!